این بخش توضیح میدهد که چگونه هوش مصنوعی (AI) میتواند استقرار دولت دیجیتال را تسریع کند. این بخش، دولت را به عنوان توسعهدهنده و کاربر هوش مصنوعی، فراتر از نقشهای سنتی سرمایهگذار و تنظیمکننده، قرار میدهد و فرصتها – بهرهوری (کارایی و اثربخشی)، پاسخگویی و مسوولیتپذیری – را در سراسر چرخه سیاستگذاری دستهبندی میکند و بر پیشنیازها در مدیریت دادهها و اطلاعات تأکید میکند. همچنین خطرات خاص دولت و خطرات عدم اقدام را در رویکردهای نظارتی نوظهور تشریح میکند و با چشماندازی برای هوش مصنوعی قابل اعتماد در دولت به پایان میرسد.

۱- استقرار دولت دیجیتال

دولت دیجیتال برای تغییر فرآیندها و خدمات به روشهایی که پاسخگویی و قابلیت اطمینان بخش عمومی را بهبود میبخشد و دولتها را به مردم خود نزدیکتر میکند، ضروری است. دولتهای بالغ دیجیتال میدانند که فناوری نهتنها یک محرک استراتژیک برای بهبود کارایی است، بلکه سیاستها را موثرتر و دولتها را بازتر، پاسخگوتر، نوآورتر، مشارکتیتر و قابل اعتمادتر میکند.

همهگیری کووید۱۹ بر اهمیت فناوریها و دادههای دیجیتال در ایجاد تابآوری اقتصادی و اجتماعی از طریق رویکردهای راهبردی، چابک و نوآورانه دولت تاکید کرد. درحالیکه این همهگیری و بحران چندبعدی ناشی از آن، دولتها را مختل کرد، فرصتی را نیز برای بازنگری رویکردهای راهبردی درمورد استفاده از ابزارها و دادههای دیجیتال برای بهبود ارایه خدمات عمومی فراهم کرد. دولتها که هیچ جایگزینی نداشتند، سالها پیشرفتهای فناوری را در هفتهها و ماهها فشرده کردند. استقرار راهحلهای فناوری در مقیاس وسیع، دولتها را قادر ساخت تا در مواقع بحرانی به فعالیت خود ادامه دهند و ارایه به موقع خدمات به شهروندان و مشاغل را تضمین کنند. در مواردی که فناوریها یا دادههای دیجیتال بهصورت راهبردی یا موثر مورد استفاده قرار نگرفتند، این بحران شکافها و چالشهای تشدیدشدهای را برجسته کرد که دولتها تا به امروز برای رفع آنها تلاش میکنند.

نهادینه کردن دولت دیجیتال، با سطوح بلوغ متفاوت

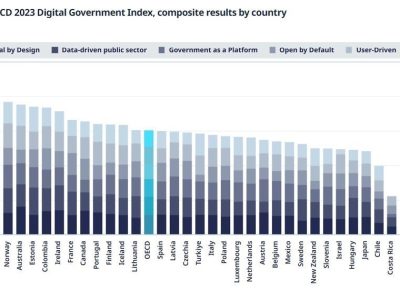

برای آزادسازی ظرفیت دولت دیجیتال، ایجاد ترتیبات نهادی مناسب، سازوکارهای هماهنگی و ابزارهای سیاستی برای حفظ تحولات بلندمدت موردنیاز و غلبه بر اولویتهای سیاسی درحال تغییر، بسیار مهم است. چارچوب سیاست دولت دیجیتال OECD 6 بُعد حیاتی برای ایجاد یک دولت دیجیتال را تعیین میکند:

- طراحی دیجیتال: طراحی سیاستهایی برای فعالکردن بخش عمومی برای استفاده منسجم از ابزارها و دادههای دیجیتال هنگام تدوین سیاستها یا تغییر خدمات عمومی.

- دادهمحور: توسعه حاکمیت و توانمندسازهای موردنیاز برای دسترسی، اشتراکگذاری و استفاده مجدد از دادهها در سراسر بخش عمومی.

- دولت بهعنوان یک نرمافراز: استقرار بلوکهای سازنده مشترک مانند دستورالعملها، ابزارها، دادهها، هویت دیجیتال و نرمافزار برای پیشبرد یک تغییر منسجم در فرآیندها و خدمات دولتی در سراسر بخش عمومی.

- باز بودن بهطور پیشفرض: باز بودن فراتر از انتشار دادههای باز، ازجمله تلاش برای تشویق استفاده از فناوریها و دادهها برای برقراری ارتباط و تعامل با بازیگران مختلف.

- کاربرمحور: قراردادن نیازهای کاربر در هسته طراحی و ارایه سیاستها و خدمات عمومی، ازجمله از طریق تعامل با کاربران و اندازهگیری معیارها برای ارزیابی تاثیر و رضایت.

- کنشگری: پیشبینی نیازهای کاربران و ارایهدهندگان خدمات برای ارایه خدمات دولتی بهصورت کنشگرانه.

شاخص دولت دیجیتال OECD (DGI) بلوغ دولتها را در این ابعاد ارزیابی میکند (شکل ۱.۱). در این شکل، مشخص است که برخی کشورها در مسیر خود بهسمت بلوغ دولت دیجیتال، پیشرفت بیشتری نسبتبه سایرین داشتهاند و طیف گسترده تحلیلهای OECD درمورد دولت دیجیتال نشان میدهد که هر کشور با چالشهای خاص خود در دستیابی به بلوغ مواجه است.

نقش رو به رشد هوش مصنوعی در دولت دیجیتال

سازمان همکاری و توسعه اقتصادی (OECD) یک سیستم هوش مصنوعی را اینگونه تعریف میکند: «یک سیستم مبتنی بر ماشین که برای اهداف صریح یا ضمنی، از ورودیهایی که دریافت میکند، استنباط میکند که چگونه خروجیهایی مانند پیشبینیها، محتوا، توصیهها یا تصمیماتی را تولید کند که میتوانند بر محیطهای فیزیکی یا مجازی تاثیر بگذارند.»

بحثهای جهانی هوش مصنوعی عمدتا بر دولتها بهعنوان تنظیمکننده یا سرمایهگذار هوش مصنوعی متمرکز است اما فرصتهای قابلتوجهی برای دولت بهعنوان توسعهدهنده و کاربر هوش مصنوعی وجود دارد. دولتها نهتنها اولویتها، سرمایهگذاریها و مقررات ملی را برای هوش مصنوعی تعیین میکنند، بلکه بهطور فزایندهای از آن برای طراحی و اجرای سیاستها و خدمات استفاده میکنند. اگرچه در سالهای اخیر تبلیغات پیرامون هوش مصنوعی افزایش یافته است، دولتها در استفاده از هوش مصنوعی تازهکار نیستند. هزاران پروژه هوش مصنوعی دولتی در سراسر جهان درحال انجام است.

درحالیکه برخی دولتها طیف گستردهای از ابتکارات را برای افزایش ظرفیت خود در استفاده از هوش مصنوعی بهکار گرفتهاند، پیادهسازی هنوز برای بیشتر آنها یک چالش است. در زمان انتشار DGI، ۷۰ درصد از کشورها از هوش مصنوعی برای بهبود فرآیندهای داخلی دولت استفاده کرده بودند، درحالیکه تنها ۳۳ درصد از هوش مصنوعی برای بهبود طراحی و اجرای سیاست استفاده کرده بودند. اگرچه استفاده از آن در حال افزایش است، استفاده از هوش مصنوعی در دولت هنوز تاثیر تحولآفرینی نداشته است.

۲- درک ظرفیت تحولآفرین هوش مصنوعی

هوش مصنوعی یکی از دگرگونکنندهترین نیروهای قرن بیستویکم است. این فناوری با سرعتی بیسابقه درحال تغییرشکل صنایع، اقتصادها، دولتها و جوامع است. اگر دولتها و سایر بازیگران هوش مصنوعی در بهرهبرداری از مزایای هوش مصنوعی و درعینحال کاهش خطرات آن موفق باشند، کارشناسان و محققان هوش مصنوعی آیندهای را تصور میکنند که در آن هوش مصنوعی به پیشرفتهای علمی و پزشکی، مانند کشف درمانهای جدید سرطان، کمک میکند؛ رشد بهرهوری را از افزایش یک تا هفت درصدی تولید ناخالص داخلی جهانی (GDP) تا سال ۲۰۳۳ به افزایش ۱۰برابری در دهههای آینده تسریع میکند؛ فقر را از بین میبرد و نابرابری را کاهش میدهد و به مقابله با تاثیرات مرتبط با آبوهوا و بلایای طبیعی کمک میکند.

باوجود هیاهوی تبلیغاتی، پیشرفت هوش مصنوعی محدود است

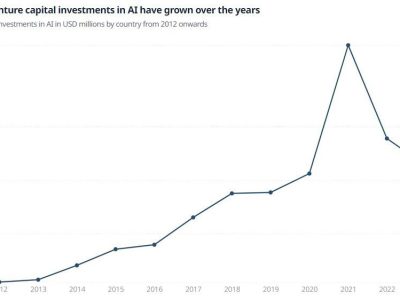

دادههای رصدخانه سیاست OECD.AI نشاندهنده افزایش علاقه به هوش مصنوعی در سالهای اخیر است؛ برای مثال، شکل ۱.۲ رشد قابلتوجه سرمایهگذاریهای خطرپذیر در هوش مصنوعی را در طول زمان نشان میدهد. انتظار میرود GenAI و برخی دیگر از اشکال هوش مصنوعی، مانند ابررایانههای هوش مصنوعی و استفاده از هوش مصنوعی برای پشتیبانی و اجرای سیاستهای حاکمیت هوش مصنوعی، اعتماد، ریسک و امنیت، تنها در دو تا پنج سال به بهرهوری کاملتری برسند.

اگرچه برخی از کارشناسان هوش مصنوعی، دستاوردهای اقتصادی قابلتوجهی را از هوش مصنوعی پیشبینی میکنند، تحقیقات OECD رشد ضعیفتری را نشان میدهد و رشد بهرهوری سالانه ناشی از هوش مصنوعی را بین ۰.۲۵ تا ۰.۶ درصد در ۱۰ سال آینده در کشورهایی که بیشترین آمادگی را برای هوش مصنوعی دارند، تخمین میزند. تحقیقات نشان میدهد که هوش مصنوعی، بهرهوری فردی کارگران را بهبود میبخشد اما شواهدی که این را به دستاوردهای سازمانی و اقتصادی گستردهتر مرتبط میکند، ضعیف است. این تا حدودی به این دلیل است که برخی از وظایف هنوز نمیتوانند ازطریق هوش مصنوعی انجام شوند و همه سازمانها یا کارگران آماده پذیرش آن نیستند. برخی شواهد نشان میدهد شرکتهایی که هوش مصنوعی را اتخاذ میکنند، مولدتر هستند و سریعتر از شرکتهایی که این کار را نمیکنند، رشد میکنند اما این نباید بهعنوان علیت تفسیر شود. درحالحاضر، محدودیتها همچنان پابرجاست. طبق آمار اداره سرشماری ایالاتمتحده، تنها ۵ تا ۶ درصد از کسبوکارهای آمریکایی از هوش مصنوعی برای تولید کالا و خدمات استفاده میکنند و تنها هفت درصد قصد دارند در ماههای آینده از آن استفاده کنند. در یک نظرسنجی جهانیتر، تخمین زده میشود که تنها ۲۶ درصد از شرکتها قابلیتهای لازم برای استخراج ارزش واقعی از هوش مصنوعی را دارند و تنها چهار درصد در تولید ارزش قابلتوجه موفق بودهاند.

فراتر از دستاوردهای اقتصادی، پتانسیل تحولآفرین هوش مصنوعی برای دستیابی به نتایج مثبت اجتماعی، نشانههایی از نویدبخش بودن را نشان میدهد. بااینحال، تاثیر کامل آن هنوز محقق نشده است؛ بهعنوانمثال، هوش مصنوعی در علم به پیشرفت واقعی در رباتیک، همجوشی هستهای، کشف دارو، تولید آنتیبادی و تاخوردگی پروتئین کمک کرده است. با وجود این موفقیتهای اولیه، بسیاری از کاربردها همچنان محلی یا تجربی هستند و تغییرات سیستمی در مقیاس جهانی هنوز در راه است. سهم هوش مصنوعی در علم تازه آغاز شده و در برخی زمینهها، این فناوری ممکن است کمتر از حد انتظار به موفقیت رسیده باشد؛ برای مثال، برخی دریافتند که هوش مصنوعی در طول همهگیری کووید۱۹ سهم کمی در تحقیقات داشته است. تاکنون، هوش مصنوعی عمدتا به پیشرفتهایی در مجموعهای محدود از علوم طبیعی و فیزیکی کمک کرده است. تحولات مشابه در سایر رشتهها، مانند علوم اجتماعی، باوجود انتظارات بالا، پیشرفت کمتری داشتهاند. به این ترتیب، درحالیکه مزایای اجتماعی هوش مصنوعی درحال ظهور است، دامنه کامل پتانسیل تحولآفرین آن هنوز در حال آشکار شدن است.

استفاده از هوش مصنوعی در دولت، زمینهای منحصربهفرد

دولتها علاوهبر مدیریت هوش مصنوعی برای جامعه با تعیین شرایط و مقررات برای استفاده قابل اعتماد از آن، در تلاشاند تا این فناوری را برای مدیریت بهتر با هوش مصنوعی ادغام کنند. مشابه بخش خصوصی، استفاده از هوش مصنوعی در دولت مزایای فوقالعادهای را نوید میدهد، درحالیکه خطرات و چالشهایی را نیز به همراه دارد. درواقع، یک نظرسنجی از ۲۷۷۰ رهبر ارشد در ۱۴ کشور نشان داد که رهبران بخش دولتی دوبرابر رهبران صنعت، تحول مبتنی بر هوش مصنوعی را در سازمانهای خود در کوتاهمدت پیشبینی میکنند اما آنها محتاطتر و کمتر خوشبین بودند که این امر منجر به افزایش بهرهوری شود. بااینحال، این موضوع اخیرا به کانون توجه ادبیات مدیریت عمومی جریان اصلی و بسیاری از دولتها تبدیل شده است. بااینحال، استفاده دولت از هوش مصنوعی از بخش خصوصی عقبتر است.

حوزه هوش مصنوعی پیچیده است، بهسرعت درحال پیشرفت است و منحنی یادگیری شیبداری برای کارمندان دولت و سیاستگذاران دارد. بااینحال، در صورت موفقیت، کاربرد هوش مصنوعی در دولت نویدبخش تاثیر قابلتوجهی بر اقتصاد و جامعه گستردهتر با افزایش کیفیت و نتایج خدمات عمومی، سیاستها و عملیات دولتی است.

دولتها نفوذ و تاثیر زیادی بر زندگی مردم دارند و وظیفه مراقبت از منافع عمومی را به همراه دارند؛ وظیفهای که فراتر از شرکتها است؛ بنابراین، آنها مسوولیت ویژهای برای استقرار هوش مصنوعی به گونهای دارند که آسیب را به حداقل برساند و رفاه افراد و جوامع را در اولویت قرار دهد. این امر بهویژه درمورد بهکارگیری هوش مصنوعی در حوزههای حساس سیاستگذاری مانند اجرای قانون، کنترل مهاجرت، مزایای رفاهی و پیشگیری از کلاهبرداری صادق است.

دولتها همچنین با یک ماموریت منحصربهفرد فعالیت میکنند: آنها در خدمت منافع عمومی هستند و ازسوی منابع عمومی تامین مالی میشوند. به همین ترتیب، اقدامات آنها –بهویژه اقدامات مربوط به دادهها و فناوریهای دیجیتال- باید هدایت شود.

زمینهها و مزایای کلیدی هوش مصنوعی در دولت

فرصتها برای دولتها بهعنوان توسعهدهندگان و کاربران هوش مصنوعی شامل ظرفیت تغییر در ارایه خدمات، سیاستگذاری، عملیات داخلی و نظارت است. این یک لحظه محوری برای دولتها در سراسر جهان است. آنها با پیشرفتهای سریع در فناوریهای هوش مصنوعی دستوپنجه نرم میکنند و درتلاشاند تا از فرصتهای ارایهشده ازسوی هوش مصنوعی برای نوآوری و مدرنسازی مدیریت عمومی استفاده کنند.

پذیرش هوش مصنوعی در دولت، امکانات جدیدی را ایجاد میکند. طی سالها تحقیق درمورد این موضوع و همکاری با دولتها در سراسر جهان، سه زمینه فرصت مشخص برای استفاده دولت از هوش مصنوعی را شناسایی کرده است:

بهرهوری با عملیات داخلی کارآمدتر و طراحی سیاست، تصمیمگیری و ارایه خدمات موثرتر: بهعنوانمثال، استفاده از سیستمهای پیشبینی هوش مصنوعی برای برنامهریزی موثرتر سیاست، خودکارسازی فرآیندها برای ارایه خدمات سریعتر و افزایش عملکرد با اجازه دادن به کارمندان دولت برای تمرکز کمتر بر وظایف روزمره و بیشتر بر فعالیتهای حیاتی.

پاسخگویی سیاستها و خدمات عمومی از طریق رویکردهای طراحی و ارایه بهبود یافته که نیازهای درحال تحول شهروندان و جوامع خاص را بهتر برآورده میکنند و همچنین از طریق بهبود سازوکارهای مشارکت مدنی. این شامل ارایه خدمات عمومی شخصیسازیشدهتر و پیشگیرانهتر میشود.

پاسخگویی با افزایش ظرفیت نظارت و شفافیت؛ برای مثال از طریق نظارت بلادرنگ. این تغییر ممکن است رضایت کلی عمومی را افزایش داده و درک دولت را بهعنوان نهادی شایسته، منصف و پاسخگو تقویت کند و درنتیجه اعتماد عمومی به ظرفیت دولت برای نوآوری و تحول را تقویت کند.

3- مزایای کلیدی هوش مصنوعی در دولت

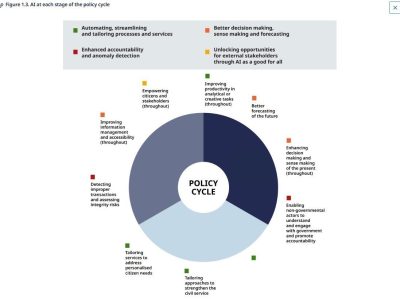

برای هدایت تصمیمات سرمایهگذاری، درک مزایای هوش مصنوعی برای کارمندان دولت، بهویژه تصمیمگیرندگان در سمتهای رهبری، بسیار مهم است. مطالعهای ازسوی کمیسیون اروپا (EC)، که ۵۷۶ مدیر دولتی را در هفت کشور مورد بررسی قرار داد، نشان داد که مزایای درکشده از هوش مصنوعی بهطور قابلتوجهی بر پذیرش آن تاثیر میگذارد. هوش مصنوعی ظرفیت افزایش تصمیمگیری در مراحل مختلف چرخه سیاستگذاری را دارد (شکل ۱.۳). بخشهای زیر مزایای کلیدی استفاده از هوش مصنوعی در دولت را شرح میدهند. این مزایا منحصربهفرد نیستند و درواقع مکمل یکدیگر هستند و در چهار مفهوم با هم همپوشانی دارند:

فرآیندها و خدمات خودکار، ساده و متناسب؛

تصمیمگیری، حسگرایی و پیشبینی بهتر؛

پاسخگویی و تشخیص ناهنجاری پیشرفته؛

و ایجاد فرصتها برای ذینفعان خارجی از طریق هوش مصنوعی بهعنوان یک مزیت برای همه.

3-1- فرآیندها و خدمات خودکار، ساده و متناسبسازیشده

اتوماسیون مبتنی بر هوش مصنوعی میتواند بهطور مستقیم به خودکارسازی فرآیندها و خدمات موجود کمک کند، یا به بازطراحی کامل نحوه عملکرد دولتها، چه در عملیات داخلی و چه در خدمات عمومی، کمک کند. دولتها با بهرهگیری از داراییهای عظیم داده، میتوانند از هوش مصنوعی برای توسعه خدمات متناسبسازیشدهای که دقیقا برای افراد و گروههای خاص طراحی شدهاند، استفاده کنند. این مزایا نهتنها دولت را کارآمدتر، موثرتر و پاسخگوتر میکند، بلکه میتواند با قادر ساختن آنها به صرف زمان بیشتر روی کارهای ارزشمندتر و معنادارتر، کیفیت شغلی و رفاه کارکنان دولت را نیز بهبود بخشد. نشان داده شده است که این امر رفاه کارگران را بهبود میبخشد. تقریبا دوسوم از کارگرانی که ازسوی OECD مورد بررسی قرار گرفتند، گزارش دادند که هوش مصنوعی لذت آنها از کار را بهبود بخشیده است و مطالعات نشان میدهد این امر میتواند رفاه کارگران را افزایش دهد. بااینحال، همانطور که در ادامه بحث شده است، برخی کاربردهای هوش مصنوعی میتوانند کیفیت شغلی را کاهش داده و بهطور بالقوه منجر به جابهجایی نیروی کار خدمات عمومی شوند.

3-1-1- خودکارسازی وظایف روزمره و تکراری

دولتها میتوانند از هوش مصنوعی برای افزایش کارایی عملیات داخلی و فعالیتهای ارایه خدمات خود استفاده کنند و زمانی را که مقامات دولتی صرف وظایف یکنواخت میکنند، کاهش دهند. معمولا این عملیات داخلی تکراری هستند و به تفکر تحلیلی گسترده یا قضاوت انسانی نیازی ندارند. با خودکارسازی این وظایف، هوش مصنوعی میتواند گردش کار را ساده کند، خطاها را کاهش دهد، تخصیص منابع را بهینه کند و منابع انسانی را برای فعالیتهای پیچیدهتر و قضاوتمحور آزاد کند. درنهایت، این امر منجر به ارایه کارآمدتر خدمات عمومی با کیفیت بالاتر میشود.

وظایف تکراری و وقتگیر عبارتاند از:

ورود دادهها: وارد کردن دستی دادهها به سیستمها و پایگاههای داده مختلف.

پردازش حقوق و دستمزد: محاسبه و پردازش حقوق و مزایای کارکنان.

سوالات اساسی مشتری: رسیدگی به سوالات روزمره و ارایه اطلاعات به عموم.

تایید اطلاعات: بررسی و تایید صحت اسناد.

پردازش فرم: رسیدگی و پردازش فرمهای مختلف درخواست.

ایمیل و مکاتبات: مرتبسازی، پاسخدهی و مدیریت ایمیلها و مکاتبات رسمی.

دولتها میتوانند از انواع سیستمهای هوش مصنوعی برای این نوع وظایف استفاده کنند، از سیستمهای ساده مبتنی بر قوانین گرفته تا سیستمهای پیشرفتهتر یادگیری ماشین، مانند چتباتهای مجهز به LLM. این سیستمها قابلیتهای گستردهای دارند، از رسیدگی به سوالات ساده و روتین (هم با شهروندان و هم با کارمندان دولت) گرفته تا تولید محتوای کاملا جدید و سفارشی و بهینهسازی تخصیص منابع.

برای مثال، آرژانتین ازطریق سیستم Prometea مبتنی بر هوش مصنوعی خود، درحال خودکارسازی وظایف تکراری و تسریع پردازش پروندهها در اداره دادگستری است. بااینحال، همانطور که در ادامه بحث شده است، اتوماسیون مجهز به هوش مصنوعی میتواند خطراتی را -در زمینههایی مانند اداره دادگستری- ایجاد کند که دولتها باید آنها را در نظر بگیرند؛ برای مثال، درمورد پرومتئا، آرژانتین بهدنبال محدودکردن این خطرات ازطریق کنترل انسانی بر نحوه استفاده از سیستم هوش مصنوعی و خروجیهای آن است.

۳-۱-۲- بهبود بهرهوری در وظایف تحلیلی یا خلاقانه

هوش مصنوعی از طریق کشف ایدههای جدید و از طریق ابزارهای جدید کارآمد و موثر برای انجام کار، به بهرهوری کمک میکند. یکی از قابلتوجهترین مزایای هوش مصنوعی، توانایی آن در کمک به ادارات دولتی برای مدیریت و مدیریت تجزیه و تحلیل و ترکیب اسناد گسترده است. درحالیکه ابزارهای متنوع مبتنی بر هوش مصنوعی ممکن است مفید باشند، LLMها بهویژه میتوانند بهعنوان دستیاران قدرتمندی برای مقامات دولتی در این زمینه عمل کنند و در وظایفی مانند تحقیق، خلاصهسازی و ترکیب محتوا کمک کنند. تحقیقات انجامشده با متخصصان دانش در بخش خصوصی نشان داد که استفاده از هوش مصنوعی میتواند عملکرد افراد و تیمها را بهبود بخشد. دولتها میتوانند از هوش مصنوعی برای کاهش حجم کار کارمندان دولت و بهبود دسترسی به اطلاعات برای شهروندان و کارمندان دولت استفاده کنند.

برخی کاربردهای مرتبط عبارتاند از:

پردازش و دستهبندی اطلاعات متنی: ابزارهای هوش مصنوعی میتوانند متون گسترده و اسناد بدون ساختار را بهسرعت و بادقت تجزیه و تحلیل کنند، نکات کلیدی را برجسته کرده و اطلاعات را خلاصه کنند. این امر باعث افزایش کارایی در بخشهایی میشود که با حجم زیادی از اطلاعات، مانند امور حقوقی و فرآیندهای اداری سروکار دارند. درنتیجه، گردش کار سرعت میگیرد و خطر خطای انسانی کاهش مییابد و منجر به نتایج دقیقتر و قابلاعتمادتری در عملیات داخلی و فعالیتهای ارایه خدمات میشود.

تهیه پیشنویس اسناد و متون حقوقی: سیستمهای هوش مصنوعی میتوانند با استفاده از الگوها و قوانین موجود، پیشنویسهای اولیه انواع مختلف اسناد را تولید کنند. این فرآیند به تضمین رعایت استانداردها و درعینحال صرفهجویی در زمان و منابع کمک میکند. علاوهبراین، هوش مصنوعی میتواند پیشنویسهای جدید را با قوانین فعلی تطبیق دهد، اختلافات احتمالی را شناسایی کند و خطاهای انسانی را به حداقل برساند. برای تهیه پیشنویس گزارش، ابزارهای هوش مصنوعی میتوانند پیشنهادهای خودکار برای ساختارهای واضحتر و مختصرتر ارایه دهند. علاوهبراین، میتواند با خلاصهکردن گزارشهای گسترده در قالبهای کوتاهتر برای انتشار به تصمیمگیرندگان یا عموم، ارتباط با آنها را بهبود بخشد.

درک ورودیهای بدون ساختار: هوش مصنوعی میتواند مقادیر زیادی از اطلاعات را از فرآیندهای مشارکتی، بازخورد خدمات عمومی و مشاورهها تجزیه و تحلیل و ترکیب کند و آنها را به توصیههای عملی تبدیل کند. میتواند موضوعات تکراری را شناسایی کند، نظرات را دستهبندی کند، دادههای پرت را تشخیص دهد، تحلیل احساسات انجام دهد و گزینههای سیاستی را براساس ترجیحات رتبهبندی کند. این استفاده میتواند به شناسایی مسایل نوظهور، توجه بهتر به نگرانیهای ذینفعان و پرداختن به تاثیرات بالقوه سیاستها کمک کند.

مطالعات نشان میدهد که سیستمهای هوش مصنوعی مولد، زمانی را که افراد صرف انجام وظایف میکنند، کاهش میدهند و درعینحال کیفیت خروجی را بهبود میبخشند. آنها همچنین نشان میدهند که این ابزارها تاثیر بیشتری بر بهرهوری کارگران کممهارتتر، مانند کارمندان جوان، دارند و به آنها اجازه میدهند تا با همکاران ارشدتر خود همگام شوند. این میتواند با کمک به کارگران در انجام بسیاری از وظایفی که معمولا ازسوی متخصصان موضوعی انجام میشود، تاثیر برابرکننده ایجاد کند و باعث افزایش بهرهوری شود. بااینحال، برخی تحقیقات همچنین نشان میدهند هوش مصنوعی میتواند به شکاف بیشتر بین کارگران ماهر و کممهارت کمک کند و اگرچه سیستمهای هوش مصنوعی موجود میتوانند بهرهوری کارگران را افزایش دهند اما هنوز نمیتوانند بسیاری از وظایفی را که انسانها میتوانند انجام دهند، انجام دهند. تحقیقات بیشتری درمورد این موضوع، ازجمله مزایای خاص هوش مصنوعی و معایب بالقوه آن برای کارمندان دولت، موردنیاز است.

برای مثال، سازمان امور مالیاتی بریتانیا از هوش مصنوعی برای تهیه پیشنویس شرح شغل و تجزیه و تحلیل و ارزیابی صلاحیت درخواستهای شغلی برای تسریع استخدام استفاده میکند. همانطورکه در ادامه بحث شده است، استفاده از هوش مصنوعی اگر به شیوهای قابلاعتماد انجام نشود، میتواند خطراتی را ایجاد کند.

هوش مصنوعی همچنین میتواند بهعنوان شتابدهندهای برای خلاقیت و نوآوری در بین کارمندان دولت و نحوه طراحی و اجرای فرآیندهای داخلی و سیاستها و خدمات عمومی ازسوی آنها نقش داشته باشد؛ برای مثال، هوش مصنوعی مولد میتواند از کاوش در گزینههای سیاستی، شبیهسازی سناریوها، تدوین قوانین و نمونهسازی خدمات پشتیبانی کند و یک مدیریت عمومی خلاقتر و تجربیتر را پرورش دهد؛ برای مثال، سرویس ارتباطات دولتی بریتانیا درحال توسعه یک ابزار مکالمه مبتنی بر هوش مصنوعی برای تولید متون پیشنویس، برنامهها و ایدههای استراتژیک است که دستورالعملهای ارتباطی و بینش مخاطبان را برای اطمینان از خروجیهای با کیفیت بالا و مطابق با استانداردها ادغام میکند. این ابزار که بهعنوان یک دستیار مشارکتی طراحی شده است، خلاقیت را افزایش میدهد، حجم کار روتین را کاهش میدهد و پس از آزمایش موفقیتآمیز و اصلاح مکرر مبتنی بر هوش مصنوعی، بهتدریج درحال گسترش است.

۳-۱-۳- متناسبسازی خدمات برای رفع نیازهای شخصیسازیشده شهروندان

هوش مصنوعی میتواند به دولتها کمک کند تا نیازها و رفتارهای مردم را بهتر درک کنند و ارایه اطلاعات و خدمات هدفمند و شخصیسازیشده را در سطح فردی تسهیل کنند. این میتواند شامل توسعه پروفایلهای شخصیسازیشده شهروندان، تولید و ارایه اطلاعات متناسب و شکلدهی به ارایه خدمات براساس نیازهای منحصربهفرد باشد. با بهبود پاسخگویی، چنین تلاشهایی میتوانند خدمات را کارآمدتر، موثرتر و شهروندمحورتر کنند که منجر به رضایت بیشتر، نتایج بهتر و رویکردی چابکتر و پیشگیرانهتر برای رفع نیازهای عمومی میشود.

این امر امکان پاسخ بهتر به نیازهای زیرگروههای کاربر، ازجمله گروههای آسیبپذیر و محروم، را که ممکن است نیازهای خاص و وابسته به زمینه داشته باشند فراهم میکند. استفاده از ابزارهای هوش مصنوعی برای شخصیسازی به چندین بخش خدمات عمومی گسترش یافته است که اغلب با ارایه خدمات مبتنی بر رویدادهای زندگی مرتبط هستند، مانند خدماتی که بهصورت پیشگیرانه برای تولد فرزند، پیگیریهای تحصیلی جدید یا ازدواج ارایه میشوند.

دولتها همچنین میتوانند از ظرفیت هوش مصنوعی برای تجزیه و تحلیل مجموعه دادههای رفتاری گسترده برای درک عمیقتر از ناهمگونی فردی استفاده کنند و عوامل شناختی و زمینهای -مانند زمانبندی، مکان و ترجیحات شخصی- را در طراحی خدمات بگنجانند. این امر امکان مداخلات خدماتی سازگارتر و عادلانهتری را فراهم میکند که با شرایط منحصربهفرد شهروندان همسو هستند و درعینحال از استقلال و تصمیمگیری آگاهانه محافظت میکنند.

علاوهبر بهبود خود خدمات، هوش مصنوعی میتواند به بهینهسازی ارتباطات درمورد دردسترسبودن و درنتیجه، جذب خدمات کمک کند. با استفاده از دادههای اداری موجود، هوش مصنوعی میتواند فرآیندها را با پر کردن (یا حذف) فرمها با اطلاعات شناختهشده و متناسبسازی سوالات با فرد، ساده کند و زمان و تلاش لازم برای انجام وظایف بوروکراتیک را کاهش دهد. این کار درحالحاضر بهصورت محدود با دادههای اداری و الگوریتمهای برنامهریزیشده (انسانی) در حوزه برنامههای اجتماعی انجام میشود. این رویکرد هدفمند میتواند به شهروندان کمک کند تا اطلاعات موردنیاز خود را بهطور کارآمد دریافت کنند و تعاملات با خدمات عمومی ساده و کاربرپسند باشد.

نمونههایی از این مزیت در عمل شامل طیف گستردهای از چتباتها و دستیاران مجازی است که میتوانند به سوالات منحصربهفرد شهروندان با اطلاعات متناسب پاسخ دهند؛ برای مثال، سازمان امور مالیاتی سنگاپور یک چتبات عمومی راهاندازی کرده که میتواند اطلاعات و خدمات متناسب با نیازهای فردی را ارایه دهد؛ برای مثال دیگر، سیستمهای حمایت اجتماعی از هوش مصنوعی برای اطلاعرسانی پیشگیرانه برای ارتقای جذب خدمات در بین افراد باکیفیت استفاده میکنند.

بااینحال، توجه به این نکته مهم است که چنین خدماتی اغلب برای تعیین ویژگیها و نیازهای فردی به جمعآوری و تجزیه و تحلیل دادههای زیادی نیاز دارند. دولتها باید چنین جمعآوری دادهها و استفاده از هوش مصنوعی را به شیوهای قابل اعتماد انجام دهند. در غیر اینصورت، همانطور که در ادامه بحث خواهد شد، این تلاشها خطر نقض آزادی اعمال حقوق بشر، ازجمله ازطریق نقض حریم خصوصی، را به همراه دارد.

۳-۱-۴- رویکردهای متناسبسازی برای تقویت خدمات شهری

هوش مصنوعی همچنین میتواند خدمات عمومی را ازطریق فرآیندهای استخدام موثرتر و فراگیرتر و برنامههای شخصیسازیشده برای توسعه مداوم تقویت کند؛ برای مثال، در رابطه با مدیریت منابع انسانی (HRM)، هوش مصنوعی میتواند با کمک به یافتن بهترین کاندیداها برای شغل، به دولتها در بهینهسازی تصمیمات استخدام کمک کند و با کنترل سوگیریهای انسانی، شمولیت را بهبود بخشد.

هوش مصنوعی همچنین میتواند کارمندان دولت را توانمند سازد؛ میتواند به توسعه یادگیری، افزایش خلق دانش و بهینهسازی نرمافزارهای یادگیری برای ارتقای مهارت کارمندان دولت کمک کند. این شامل تدوین استراتژیهای توسعه مهارت، طراحی و اجرای دورههای آموزشی متناسب و اجرای ابزارهایی برای بهبود دسترسی به اطلاعات است. با انجام این کار، هوش مصنوعی میتواند به اطمینان از مجهز بودن کارمندان دولت به جدیدترین دانش و مهارتهای لازم برای برآوردن خواستههای درحال تحول نقشهایشان کمک کند و مدیریت عمومی پاسخگوتری را تقویت کند.

برخی کاربردهای مرتبط هوش مصنوعی عبارتاند از:

توسعه مطالب آموزشی برای کارمندان دولت: هوش مصنوعی میتواند محتوای آموزشی (مانند ماژولها و مطالب درسی) را از اسناد منبع ایجاد و اطلاعات متنوع را در منابع مؤثر ادغام کند. همچنین میتواند دورههای یادگیری آنلاین را طراحی، ساختاردهی و مستقر کند. ابزارهای مبتنی بر هوش مصنوعی میتوانند با دسترسی به اطلاعات جدید، این منابع را بهطور مداوم بهروزرسانی و اصلاح کنند و آموزش و توسعه مداوم مهارت نیروی کار دولتی را افزایش دهند.

شخصیسازی مطالب و مسیرهای یادگیری برای کارمندان دولت: هوش مصنوعی میتواند محتوای آموزشی و مسیرهای یادگیری را متناسب با نیازها، ترجیحات و پیشرفت خاص هر کارمند دولت تنظیم کند و یک تجربه یادگیری موثرتر، جذابتر و تطبیقی را تضمین کند. با تجهیز کارآمدتر کارمندان دولت به مهارتهای مناسب، این شخصیسازی همچنین پاسخگویی دولت را افزایش میدهد.

شناسایی و فهرستبندی منابع یادگیری: ابزارهای هوش مصنوعی میتوانند منابع یادگیری متعدد را شناسایی، توصیف و فهرستبندی کنند و آنها را بهراحتی قابل جستوجو و اشتراکگذاری سازند و درنتیجه کشف منابع و شناسایی محتوای مرتبط برای زبانآموزان را ساده کنند؛ برای مثال، ادغام هوش مصنوعی در نرمافزارهای دیجیتال میتواند عملکردهای سازماندهی، فهرستبندی و جستوجو را بهبود بخشد.

برای مثال، کمیسیون خدمات عمومی استرالیا (APSC) یک پروژه آزمایشی ششهفتهای را اجرا کرده است تا ببیند آیا هوش مصنوعی میتواند یک دوره یادگیری آنلاین درمورد مهارتهای دیجیتال برای رهبری را طراحی، ساختاردهی و مستقر کند.

۲- تصمیمگیری، درک و پیشبینی بهتر

کارشناسان هوش مصنوعی، تصمیمگیری، درک و پیشبینی بهتر را بهعنوان مهمترین مزایای کلی هوش مصنوعی شناسایی کردهاند و اقدامات قویتر و سرمایهگذاریهای بیشتر ازسوی دولتها را برای دستیابی به این حوزهها توصیه میکنند. همانطور که در ادامه بحث شده است، دولتها باید این مزایا را دنبال کنند و درعینحال مراقب باشند که از اتکای بیشازحد به هوش مصنوعی خودداری کنند، زیرا شناسایی نقص در سیستمها میتواند دشوار باشد و واگذاری بیشازحد قضاوت انسانی به ماشینها میتواند باعث انتشار سیستماتیک خطاها و ایجاد آسیب در دنیای واقعی شود.

۳-۲-۱- تقویت تصمیمگیری و درک زمان حال

با ارایه بینشهای عملی و مبتنی بر داده، هوش مصنوعی میتواند به دولتها کمک کند تا اثربخشی و کارایی اقدامات هدفمند را بهبود بخشند، منابع را تخصیص دهند و مشکلات و راهحلهای سیاستی را شناسایی کنند؛ بنابراین، دولتها میتوانند بهطور موثرتری به مسایل نوظهور پاسخ دهند، میتوانند توسعه آگاهانه سیاستها را تضمین کنند، پاسخگویی و مسوولیتپذیری کلی خود را افزایش دهند و در نهایت، رفاه اجتماعی را ارتقا دهند.

برخی از روشهای خاصی که هوش مصنوعی میتواند در طول چرخه سیاستگذاری مفید باشد، عبارتاند از:

تنظیم دستورکار و تدوین سیاست: هوش مصنوعی میتواند با چارچوببندی مشکلات اجتماعی به شیوههایی که آنها را به نیازهای واقعی اجتماعی پاسخگوتر میکند، نقش محوری در جلب توجه سیاستگذاران و در فرآیند تنظیم دستورکار ایفا کند؛ بهعنوان مثال، هوش مصنوعی دولتها را قادر میسازد تا موضوعات نوظهور را در زمان واقعی از مجموعه دادههای گسترده و نماینده رصد و درک کنند و دقت و سرعت تنظیم دستورکار را افزایش دهند. با تشخیص دقیقتر و سریعتر چالشهای بالقوه، هوش مصنوعی پاسخهای سریعتر به سیاستها را قبل از تشدید مسایل تسهیل میکند. هوش مصنوعی ازطریق تدوین سیاست، میتواند با ارایه دادهها و اطلاعات مهم درمورد مسایل، بر فرآیند تصمیمگیری تاثیر بگذارد. تجزیه و تحلیل مبتنی بر هوش مصنوعی میتواند بینشهایی را ارایه دهد که نهتنها تاثیرات احتمالی سیاستها را تخمین میزند، بلکه جمعیتهای هدف را نیز شناسایی کرده و تشخیصهای اقتصادی و اجتماعی را انجام میدهد و به سیاستگذاران در تصمیمگیری آگاهانه کمک میکند. هوش مصنوعی همچنین میتواند در تدوین گزینههای سیاستی کمک کند و ارزیابی عمیقتری از سیاستهای پیشین ارایه دهد.

اجرای سیاست: با ورود سیاستها به مرحله اجرا، اتوماسیون مبتنی بر هوش مصنوعی، پردازش سریع دادهها و تجزیه و تحلیل بلادرنگ، کیفیت، سرعت و کارایی اجرای سیاست را افزایش میدهد. تجزیه و تحلیل هوش مصنوعی بهطور قابلتوجهی کسب دادهها و اطلاعات را تقویت و تسریع و از بهبودهای مستمر پشتیبانی میکند. تجزیه و تحلیل دادههای بلادرنگ میتواند پیشرفتهای گسترده را تسهیل کند و درنهایت ارایه خدمات را در طول اجرای سیاست بهبود بخشد.

نظارت و ارزیابی: هوش مصنوعی میتواند مداخلات سیاستی را در زمان واقعی رصد کند، بینش بهتری در مورد فرآیند سیاستگذاری ارایه دهد، ارزیابی دادههای بهموقع و دقیق از مداخلات سیاستی را تسهیل کند و در صورت نیاز، تنظیمات سریع سیاستی را امکانپذیر سازد.

دادههای در دسترس و افزایش قدرت محاسباتی، در برخی موارد، در تصمیمگیری، به هوش مصنوعی مزیت رقابتی نسبت به انسان میدهد؛ برای مثال، LLMها میتوانند از استدلال فردی پشتیبانی کنند و شواهد، مزایای تصمیمگیری با کمک هوش مصنوعی را در دنیای واقعی نشان میدهند. سیستمهای هوش مصنوعی میتوانند با کاهش اشتباهات استدلالی و خطاهای شناختی، تصمیمگیری را بهبود بخشند و به انسانها کمک کنند تا «نویز» -تنوع ناخواسته در تصمیمگیری انسان- و تاثیرات نامربوطی را که میتواند منجر به تصمیمات متناقض و نادرست شود، فیلتر کنند. پتانسیل سیستمهای هوش مصنوعی برای تصمیمگیری مبتنی بر داده، منجر به پذیرش آن در طیف وسیعی از بخشها، ازجمله در بخش دولتی، میشود. هوش مصنوعی میتواند عناصری را که قضاوت انسان را در کاربردهای مختلف در دولت تحریف میکنند، شناسایی و برطرف کند.

علاوهبر این، نویز ممکن است بینشهای کلیدی در مورد رفتار انسان را مبهم کند، که هوش مصنوعی میتواند آنها را کشف و کمی و به سیاستگذاری دقیقتر کمک کند. الگوریتمها میتوانند با تضمین ثبات در نتایج، صرفنظر از عوامل زمینهای، مانند خلقوخو یا زمان روز، نویز را بهطور قابلتوجهی کاهش دهند. هوش مصنوعی با کشف الگوهای رفتاری که قبلا کشف نشده یا مبهم بودهاند، میتواند به سیاستگذاران اجازه دهد تا روندهای سیستمی و تناقضات تصمیمگیری را بهتر درک کنند. اگرچه حذف نویز همه اشتباهات یا خطاها را برطرف نمیکند، قابلیت اطمینان را افزایش میدهد و اختلافات خودسرانه در تصمیمگیریها را در بین عملکردهای دولتی مانند اداره دادگستری و ارایه خدمات عمومی کاهش میدهد.

با جا افتادن بیشتر هوش مصنوعی در مدیریت عمومی، درک فرآیندهای روانشناختی و شناختی که تعاملات انسان با این فناوریها را شکل میدهند، بهطور فزایندهای اهمیت مییابد. مدیریت عمومی رفتاری میتواند بینشهای ارزشمند بیشتری درمورد چالشهایی که ممکن است پیش بیاید، ارایه دهد و استراتژیهایی را برای کاهش آنها و بهبود حکمرانی و تصمیمگیری ارایه دهد. نمونهای از این مورد، استفاده دولتها از Polis، یک ابزار مشارکت مدنی متنباز برای درک دیدگاههای شهروندان و همچنین زمینههای اجماع و اختلافنظر درمورد مسایل مربوط به سیاست عمومی است. در زمینه مدیریت مالی عمومی، کره dBrain+ را توسعه داده است، یک سیستم اطلاعاتی که از هوش مصنوعی برای تجزیه و تحلیل دادههای اقتصادی، مالی و پولی در زمان واقعی برای بهینهسازی ارزیابی ریسک و تصمیمگیری در امور مالی عمومی استفاده میکند.

۳-۲-۲- پیشبینی بهتر آینده

سیستمهای هوش مصنوعی میتوانند حجم زیادی از دادهها را از منابع متعدد، ازجمله دادههای بدون ساختار، پردازش کنند و الگوهای پیچیده و سیگنالهای ضعیف -نشانههای اولیه تغییرات، تهدیدها و فرصتهای نوظهور بالقوه- را که با روشهای موجود بهراحتی قابل تشخیص نیستند، شناسایی کنند. این امر میتواند دقت و بهموقع بودن پیشبینیها را افزایش دهد و برای سایر فعالیتهای آیندهنگری استراتژیک بسیار مفید باشد. تجزیه و تحلیل و پیشبینی پیشبینی هوش مصنوعی در دولت شامل استفاده از الگوریتمها برای پیشبینی روندها و خطرات آینده است. این روش میتواند بهطور گسترده در حوزههای مختلف، مانند پیشبینی نتایج اقتصاد کلان و مالی به کار گرفته شود.

با ارایه بینشهای دقیق و بهموقع آیندهنگر، هوش مصنوعی تصمیمگیری، تخصیص منابع و اثربخشی کلی عملیات دولت را افزایش میدهد. برخی از کاربردهای مرتبط هوش مصنوعی عبارتاند از:

پیشبینی نیازهای خدمات آینده: هوش مصنوعی ظرفیت مهمی در تولید تجزیه و تحلیل و پیشبینی پیشبینیکننده دارد و به خدمات عمومی اجازه میدهد نیازها را پیشبینی کرده و پیشگیرانه عمل کنند. هوش مصنوعی میتواند با امکان تجزیه و تحلیل دادهها و روندهای تاریخی، به پیشبینی نیازهای خدماتی آینده، بهینهسازی تخصیص منابع و افزایش پاسخگویی در حوزههای مختلف سیاستگذاری کمک کند.

پیشبینی نظارتی: تنظیمکنندگان میتوانند از هوش مصنوعی برای کشف روندها و تغییرات نوظهور در صنایع مختلف استفاده کنند تا بهطور پیشگیرانه واکنشهای نظارتی را برنامهریزی کنند. با نظارت و تجزیه و تحلیل مداوم دادهها از منابع مختلف، مانند گزارشهای بازار، رسانههای اجتماعی و مقالات خبری، هوش مصنوعی میتواند تحولات جدید و پیشرفتهای فناوری را که ممکن است بر چشماندازهای نظارتی تاثیر بگذارند، شناسایی کند.

مدیریت ریسک بلایا: هوش مصنوعی همچنین میتواند با تجزیه و تحلیل دادههای تاریخی و روندهای فعلی، به پیشبینی بلایای طبیعی کمک کند؛ برای مثال، سیستمهای هوش مصنوعی میتوانند تصاویر ماهوارهای و سایر دادهها را برای پیشبینی احتمال بلایای طبیعی مانند آتشسوزیهای جنگلی و زلزله تجزیه و تحلیل کنند و اقدامات پیشگیرانهای را برای به حداقل رساندن خسارات و افزایش ایمنی عمومی انجام دهند. سیستمهای هوش مصنوعی میتوانند هشدارهای اولیه و اطلاعات مفیدی را ارایه دهند تا به دولتها کمک کنند تا بهسرعت به چنین رویدادهایی پاسخ دهند و اثرات آنها را کاهش دهند.

پیشبینی خطرات فساد و کلاهبرداری: سیستمهای پیشبینی هوش مصنوعی به فعالان درستکاری کمک کرده تا پروندهها را برای بررسی بیشتر ازسوی انسان اولویتبندی کنند. اگرچه انتقال این رویکردها از تحقیقات به دولتها هنوز محدود است، بهطور پیوسته درحال رشد است؛ بهعنوان مثال، سیستمهای هوش مصنوعی میتوانند برای اولویتبندی پروندههای پرخطر و سادهسازی فرآیندهای حسابرسی استفاده شوند. آنها همچنین میتوانند با ارایه سیستمهای هشدار اولیه که فساد عمومی را براساس دادههایی مانند عوامل اقتصادی و سیاسی پیشبینی میکنند، از هدفگیری سیاستهای ضد فساد پشتیبانی کنند. تکنیکهای پیشبینی همچنین برای چندین فعالیت پاسخگویی و نظارت دولتی مبتنی بر هوش مصنوعی، مانند تشخیص کلاهبرداری مبتنی بر ریسک، کلیدی هستند، همانطور که در ادامه بیشتر مورد بحث قرار میگیرد.

بهعنوان نمونهای از پیشبینی نیازهای خدمات عمومی آینده، سیستم PrevOcupAI پرتغال قصد دارد بیماریهای مرتبط با کار و عوامل خطر مرتبط را در مدیریت عمومی پیشبینی کند تا اختلالات را به حداقل برساند.

۳-۲-۳- بهبود مدیریت اطلاعات و دسترسی

دادههای قوی و باکیفیت، پیشنیاز اساسی برای بهرهمندی از مزایای هوش مصنوعی است. هوش مصنوعی میتواند به حداکثر رساندن کیفیت و سودمندی دادهها و همچنین توانایی انسانها و ماشینها در پردازش و تجزیه و تحلیل آنها کمک کند؛ برای مثال، سیستمهای هوش مصنوعی اشکال جدیدی از جمعآوری دادهها، ازجمله تشخیص و شناسایی خودکار موارد در تصاویر، ضبطهای صوتی یا ویدیو را امکانپذیر میکنند. قابلیتها و رواج دستگاههای حسگر مجهز به هوش مصنوعی به سرعت پیشرفت کرده است و امکان رونویسی خودکار گفتار، تشخیص حرکت، تشخیص تصویر زنده و طیف گستردهای از کارهایی را که قبلا به نیروی انسانی نیاز داشتند، فراهم میکند. هوش مصنوعی همچنین میتواند نحوه ذخیره، انتشار و کاربرد اطلاعات را بهبود بخشد. این امر بهویژه با ادغام هوش مصنوعی در سیستمهای مدیریت دانش قابل مشاهده است.

بهبود نحوه مدیریت اطلاعات در داخل دولتها همچنین میتواند به دولتها در ارایه اطلاعات و دادههای باز به عموم کمک کند. استفاده از هوش مصنوعی میتواند بهحداقلرساندن خطاها در مدیریت دادهها، مانند کاهش تلاشهای دستی، کمک کند و هنگامی که در ترکیب با فناوریهای افزایش حریم خصوصی (PETs) استفاده میشود، میتواند به افزایش حریم خصوصی و حفاظت از دادهها و اطلاعات شخصی حساس کمک کند. این بهنوبه خود، امکان انتشار گستردهتر و دسترسی به دادههای باز را فراهم میکند؛ برای مثال، در اداره دادگستری، یک موتور ناشناسسازی مبتنی بر هوش مصنوعی میتواند بهطور خودکار دادههای شخصی را در تصمیمات دادگاه شناسایی و محافظت و آنها را برای انتشار عمومی بهعنوان بخشی از یک ابتکار داده باز آماده کند.

دستیاران مجازی داخلی دولت برای کارمندان دولت نمونه خوبی هستند؛ بهطوریکه Albert فرانسه و Caddy بریتانیا انبوهی از اطلاعات تاریخی و بین دولتی را در اختیار کارمندان دولت قرار میدهند تا در تصمیمگیریها به آنها کمک کرده و به سوالات شهروندان پاسخ دهند.

۳-۳- افزایش پاسخگویی و تشخیص ناهنجاری

یکی از قدیمیترین کاربردهای هوش مصنوعی در دولت، تشخیص ناهنجاریهای موجود، مانند کلاهبرداری، یا پیشبینی خطرات یکپارچگی آینده است، که درنتیجه پاسخگویی و یکپارچگی را در برنامههای عمومی افزایش میدهد. در این استفاده از هوش مصنوعی باید دقت بیشتری به عمل آید تا از نتایج احتمالی مخرب در نتایج جلوگیری شود.

۳-۳-۱- تشخیص تراکنشهای نامناسب و ارزیابی خطرات یکپارچگی

چنین فعالیتهایی در انواع عملکردهای دولتی، ازجمله تدارکات عمومی، اداره مالیات و مدیریت مالی عمومی، رایج است. کلاهبرداری و پرداختهای نامناسب در برنامههای دولتی میتوانند منابع قابلتوجهی از نشت مالی باشند؛ برای مثال، تنها در ایالاتمتحده، دولت فدرال سالانه حدود ۲۳۳ تا ۵۲۱ میلیارد دلار آمریکا را بهدلیل کلاهبرداری از دست میدهد.

الگوریتمهای یادگیری ماشین بهویژه در تشخیص الگو موثر هستند، زیرا تجزیه و تحلیل مجموعه دادههای بزرگ را امکانپذیر میکنند و دادههای پرت، روابط پنهان (مثلا نشاندهنده تبانی) و سایر ناهنجاریهایی را که به بررسی بیشتر انسان نیاز دارند، تشخیص میدهند. بدون ظرفیت تجزیه و تحلیل دادهها در مقیاس بزرگ یا قابلیت شناسایی الگوهای پنهان، چنین بینظمیهایی ممکن است بدون هوش مصنوعی بهطورکلی نادیده گرفته شوند. این استفاده از هوش مصنوعی میتواند توانایی سازمانهای دولتی را در حفظ صداقت و پاسخگویی افزایش دهد؛ برای مثال، سازمان امور مالیاتی فرانسه از هوش مصنوعی برای تجزیه و تحلیل عکسهای هوایی و شناسایی املاک اعلامنشده استفاده میکند.

دولتها میتوانند از هوش مصنوعی برای شناسایی، ارزیابی، پیشبینی و پاسخ بهتر به خطرات احتمالی صداقت استفاده کنند و مدیریت بهتر، کاهش و مداخلات بهموقع را ممکن سازند؛ برای مثال، در انطباق با مقررات، بازرسان بهطور فزایندهای از هوش مصنوعی برای ارزیابی ریسک ناشی از اپراتورهای خصوصی استفاده میکنند. این امر هدفگیری بازرسیها، حفاظت از منافع عمومی و استفاده کارآمد از منابع را بهبود میبخشد. هوش مصنوعی با تشخیص الگوهایی که نشاندهنده عدم انطباق بالقوه هستند، به بازرسان کمک و امکان ارزیابی دقیقتر ریسک را فراهم میکند. این استفاده از هوش مصنوعی نهتنها بازرسیها را ساده میکند، بلکه با اطمینان از اینکه منابع به جایی که بیشتر موردنیاز هستند هدایت میشوند، اثربخشی کلی چارچوبهای نظارتی را نیز افزایش میدهد.

۳-۳-۲- توانمندسازی بازیگران غیردولتی برای درک و تعامل با دولت و ارتقای پاسخگویی

دولتها میتوانند از هوش مصنوعی برای شفافیت بیشتر و ایجاد اشکال و کانالهای جدید تعامل بین شهروندان، سازمانهای جامعه مدنی (CSO) و نهادهای عمومی استفاده کنند. درواقع، کارشناسان هوش مصنوعی معتقدند که توانمندسازی شهروندان، سازمانهای جامعه مدنی و شرکای اجتماعی (بهعنوانمثال اتحادیههای کارگری) یکی از ۱۰ مزیت مهم هوش مصنوعی است. این امر با شفافیت دولت و استفاده از هوش مصنوعی پشتیبانی میشود. این مزایا عبارتاند از:

ارایه ابزارهای مبتنی بر هوش مصنوعی که مستقیما از دادههای دولتی باز (OGD) برای کمک به شهروندان در جهتیابی و درک فرآیندها و اقدامات دولت استفاده میکنند.

امکان نظارت و بررسی دقیق عملیات دولت ازسوی اشخاص ثالث ازطریق سازمانهای جامعه مدنی و سایر بازیگران غیردولتی.

فراهمکردن فرصتها و کانالهای تعامل که در آن مردم میتوانند بازخورد ارایه دهند و مسایل بالقوه مربوط به عملکرد و تصمیمات دولت را مطرح کنند.

اگر این استفاده از هوش مصنوعی بهخوبی اجرا شود، پتانسیل ارتقای پاسخگویی و صداقت عمومی، تقویت سیاستگذاری و افزایش اعتماد شهروندان به دولت را دارد.

3-4- فراهم کردن فرصتها برای ذینفعان خارجی از طریق هوش مصنوعی بهعنوان یک مزیت برای همه

آخرین مزیت استفاده از هوش مصنوعی در دولت، ایجاد فرصتهای جدید برای ذینفعان خارجی، مانند مشاغل و شهروندان، با فراهمکردن دسترسی آنها به سیستمهای هوش مصنوعی توسعهیافته ازطریق دولت است. این مزیت هوش مصنوعی ممکن است بهاندازه سایر مزایا بهطور مستقیم در فعالیتهای مستقیم دولت قابل مشاهده نباشد. اما این پتانسیل را دارد که ازطریق افزایش اعتماد به دولت، شهروندان آگاهتر و ماهرتر یا حتی رشد اقتصادی، حاکمیت عمومی را بهبود بخشد. کشورها برنامههای OGD را نهتنها برای ارتقای شفافیت و پاسخگویی، بلکه برای ارتقای کارآفرینی، رشد اقتصادی و ایجاد ارزشی که ممکن است لزوما در شروع آنها درک یا پیشبینی نشده باشد، اجرا کردهاند؛ برای مثال، دادههای تصاویر ماهوارهای لندست که از سال ۲۰۰۸ ازسوی سرویس زمینشناسی ایالاتمتحده بهصورت رایگان منتشر شدهاند، اکنون سالانه بیش از ۲۵میلیارد دلار ارزش اقتصادی دارند. هنگامی که جنبش OGD در اواخر دهه ۲۰۰۰ و اوایل دهه ۲۰۱۰ آغاز شد، کاملا درک نشده بود که دادههای در دسترس، یک دهه بعد بهعنوان منابع عظیمی برای آموزش سیستمهای هوش مصنوعی به کار گرفته خواهند شد.

ماهیت هوش مصنوعی کاملا متفاوت از دادههاست، زیرا محصول جانبی طبیعی مجموعهای از عملکردها و فعالیتهای موجود نیست و نمیتواند بهعنوان ورودی خام برای سایر فرآیندها عمل کند. (برای مثال، دادهها برای هوش مصنوعی با سوخت، برق یا آب آشامیدنی مقایسه شدهاند). بااینحال، استفاده دولتها از هوش مصنوعی این ظرفیت را دارد که با توانمندسازی ذینفعان برای افزایش قابلیتهای خود و دسترسی به اطلاعات برای استخراج ارزش جدید، منافع عمومی ایجاد کند.

برخلاف سایر کاربردها -که در آنها هوش مصنوعی تعاملات بین دولت و شهروندان را تسهیل میکند یا ارایه و دسترسی به اطلاعات را بهبود میبخشد- برخی از کاربردهای خاص هوش مصنوعی در حکومتداری عمومی میتواند قابلیتهای این بازیگران را افزایش دهد و آنها را قادر سازد تا بهطور موثرتری به ماموریتها و اهداف خود دست یابند؛ برای مثال، دولت هند سیستمهای هوش مصنوعی را در دسترس کشاورزان قرار داده است تا به آنها در تضمین سلامت محصولات و کاهش چالشهای مربوط به آفات کمک کند. نمونه دیگر، طرح توسعه FAIR Forward – هوش مصنوعی برای همه آلمان است که از ایجاد باز و استفاده مسوولانه از سیستمهای هوش مصنوعی در زمینههایی مانند کشاورزی، حفاظت از آبوهوا و مشارکت شهروندان پشتیبانی میکند. چنین رویکردهایی ممکن است بهویژه در بازارهایی که هنوز ازسوی راهحلهای بخش خصوصی ارایه نمیشوند یا جذابیت کمی برای آنها وجود دارد، مفید باشند. دولتها ممکن است منابع لازم برای سرمایهگذاری در زمینههای کمترکشفشده را داشته باشند و بتوانند اولین گامها را برای ایجاد بازارهای جدید بردارند و در جایی که دیگران ممکن است آماده یا مایل به آن نباشند، ریسک کنند.

اگر دولتها دسترسی به توانمندسازهای هوش مصنوعی، مانند زیرساختهای دیجیتال بهشکل قدرت محاسباتی را فراهم کنند، ظرفیت فرصتهای خارجی مثبت بیشتر تقویت میشود. در برخی موارد، این توانمندسازها ممکن است از قبل برای استفاده دولت وجود داشته باشند و فقط نیاز به برخی تنظیمات و مقیاسبندی دارند تا در دسترس مخاطبان گستردهتری قرار گیرند. در موارد دیگر، توانمندسازهایی که بازیگران خارجی را هدف قرار میدهند، میتوانند توسعه یافته و عرضه شوند. این میتواند ارزش بالقوه هوش مصنوعی را دموکراتیک کند.

نهادهای غیردولتی نیز میتوانند در ایجاد و استقرار ابزارهای هوش مصنوعی شرکت کنند و نقشهای اصلی را در تقویت مشارکت مبتنی بر فناوری ایفا کنند.

۴- خطرات خاص استفاده از هوش مصنوعی در دولت

پذیرش جهانی هوش مصنوعی در همه بخشها، سوالاتی را در مورد اعتماد، انصاف، حریم خصوصی، ایمنی و پاسخگویی و موارد دیگر مطرح میکند. درنظرگرفتن این مسایل و مدیریت خطرات هوش مصنوعی میتواند بر پذیرش آن و تحقق مزایای آن تاثیر بگذارد. هوش مصنوعی صدها خطر را ایجاد میکند و کارشناسان برخی از مهمترین آنها را برای جامعه به شرح زیر شناسایی میکنند:

اگر سیستمهای هوش مصنوعی با دادههای ناکافی یا تحریفشده پشتیبانی شوند، پیامدهای نامطلوب احتمالی برای برخی گروهها یا افراد وجود دارد.

سیستمهای هوش مصنوعی فاقد شفافیت و قابلیت توضیح کافی، پاسخگویی را از بین میبرند.

برخی کاربردهای هوش مصنوعی، نگرانیهایی را درمورد حفاظت از دادهها، حریم خصوصی و نظارت ایجاد میکنند.

هوش مصنوعی میتواند تهدیدهای سایبری پیچیدهتر را تسهیل کند.

حوادث و فجایع جزیی تا جدی هوش مصنوعی میتواند در سیستمهای حیاتی رخ دهد.

هوش مصنوعی میتواند به اختلالات بازار کار کمک کند.

قدرت محاسباتی هوش مصنوعی به مصرف انرژی بسیار قابلتوجهی نیاز دارد.

اینها مسایل پیچیدهای هستند که ازسوی دولتها، شرکتها، سازمانهای جامعه مدنی و سایر ذینفعان مربوطه درحال بررسی هستند. تلاشهایی مانند تصویب قانون هوش مصنوعی اتحادیه اروپا و انواع ابتکارات مدیریتی در سطح ملی، به نشان دادن چگونگی ایفای نقش فعال دولتها در مدیریت هوش مصنوعی برای جامعه کمک میکند.

شاید همه خطرات هوش مصنوعی بتوانند به نوعی دولتها را درگیر کنند، مانند لزوم فرآیندهای حاکمیتی یا اقدامات کاهشی. بااینحال، زیرمجموعه محدودتری از خطرات برای سیاستگذاران و کارمندان دولت، درحالیکه آنها استفاده راهبردی و مسوولانه از هوش مصنوعی در دولت را دنبال میکنند، بیشترین اهمیت را دارد. همانطور که در بالا ذکر شد، دولتها تاثیر بسیار زیادی بر زندگی مردم دارند؛ بنابراین استفاده آنها از هوش مصنوعی میتواند تاثیر بیشتری بر عموم مردم از نظر مثبت و منفی داشته باشد؛ بنابراین، انتظارات پاسخگویی برای استفاده دولت از هوش مصنوعی بیشتر است. این امر را میتوان بهصراحت در قانون هوش مصنوعی اتحادیه اروپا مشاهده کرد که بسیاری از موارد استفاده هوش مصنوعی در بخش دولتی را بهعنوان «پرخطر» و برخی را بهعنوان «خطر غیرقابل قبول» طبقهبندی میکند و بنابراین در اتحادیه اروپا ممنوع است. ایالاتمتحده رویکرد متفاوتی اتخاذ میکند و برخی از موارد استفاده را «پرتاثیر» میداند و درنتیجه شیوههای مدیریت ریسک خاصی را الزامی میکند. قانون اساسی کره درمورد توسعه هوش مصنوعی و ایجاد بنیاد اعتماد، که در ژانویه ۲۰۲۶ لازمالاجرا خواهد شد و درمورد سازمانهایی که در بازار کره درحال توسعه یا استفاده از هوش مصنوعی هستند، اعمال میشود، بهطور مشابه برخی از کاربردها را بهعنوان «تاثیر بالا» تعیین میکند، درنتیجه نیاز به اقدامات پیشرفتهتری برای تضمین ایمنی و قابلیت اطمینان هوش مصنوعی دارد. قانون اساسی هوش مصنوعی همچنین شامل یک عنوان جداگانه برای هوش مصنوعی مولد است که شامل الزامات خاص شفافیت و افشا میشود.

دولتها در تلاش برای توسعه و استفاده از هوش مصنوعی، با خطراتی مواجه هستند که شامل خطرات و تهدیدهای بالقوهای میشود که میتواند مشکلات جدی برای افراد و جامعه ایجاد کند. این موارد بهطور بالقوه اعتماد عمومی، مشروعیت استفاده از هوش مصنوعی ازسوی دولت و حتی ارزشهای دموکراتیک را تضعیف میکند. برای پرداختن به این نگرانیها، شناسایی و مدیریت این خطرات، درنظرگرفتن چگونگی تاثیر متفاوت سیستمهای هوش مصنوعی بر شهروندان یا جمعیتهای حاشیهنشین، کمک به تضمین توزیع عادلانه مزایای هوش مصنوعی و کاهش آسیبهای احتمالی، مهم است. بررسی مداوم خطرات بالقوه مهم است، زیرا خطرات شناختهشده میتوانند تکامل یابند و خطرات جدیدی پدیدار شوند، ازجمله مواردی که قبلا خارج از قلمرو امکان در نظر گرفته میشدند.

این گزارش پنج نوع کلی از خطرات برای استفاده از هوش مصنوعی در دولت را که در زیر ارایه شده است، شناسایی میکند. فراتر از دستوپنجه نرم کردن با این خطرات، دولتها هنگام تلاش برای توسعه و استفاده از هوش مصنوعی با تعدادی از چالشهای اجرایی نیز روبهرو هستند. این چالشهای اجرایی در بخش ۳ مورد بحث قرار گرفتهاند.

ریسکهای اخلاقی: این موارد شامل کاربردهای هوش مصنوعی است که اعمال آزادانه حقوق و آزادیهای بشر، ازجمله حریم خصوصی، را تضعیف میکند و بهطور بالقوه ارزشهای انسانمحور را عمدا یا سهوا نقض میکند. الگوریتمهای هوش مصنوعی میتوانند ازطریق الگوریتمهای مغرضانه و رفتارهای غیراخلاقی مانند نظارت تهاجمی، خطرات اخلاقی را از قلمرو دیجیتال به دنیای فیزیکی وارد کنند. نگرانیهای کلیدی شامل تهدیدهایی برای اعتماد، انصاف، آزادی، کرامت، استقلال فردی و حقوق کار است.

ریسکهای عملیاتی: این موارد شامل شکستهای فنی و عملیاتی است که ممکن است بهدلیل تهدیدهای سایبری، پیامدهای ناخواسته، توهمات، خطاهای سیستماتیک و اتکای بیشازحد به سیستمهای هوش مصنوعی، بر حریم خصوصی دادهها، کیفیت نتایج هوش مصنوعی و عملیات داخلی دولت تاثیر بگذارد.

ریسکهای محرومیت: این خطرات مربوط به شکافهایی است که زمانی ایجاد میشوند که شهروندان بدون دسترسی به فناوری یا سواد دیجیتال، ممکن است عقب بمانند و نتوانند از پیشرفتهای هوش مصنوعی در خدمات عمومی بهرهمند شوند.

ریسکهای مقاومت عمومی: این موارد شامل مقاومت عمومی در برابر استفاده دولت از هوش مصنوعی است. این امر میتواند ناشی از بیاعتمادی به سیستمها یا فرآیندهای هوش مصنوعی دولتی یا انتشار اطلاعات نادرست یا گمراهکننده درمورد نحوه پیادهسازی هوش مصنوعی در ادارات دولتی و تاثیرات بالقوه آن باشد.

خطرات عدم اقدام: اگرچه اغلب نادیده گرفته میشود اما این خطر شامل تاخیر دولت در استفاده از هوش مصنوعی برای دستیابی به مزایای مثبت است. این امر میتواند منجر به هزینههای مالی و غیرمالی قابلتوجهی شود -که در غیر این صورت با پذیرش موفقیتآمیز هوش مصنوعی قابل اجتناب بودند- و شکاف فزایندهای بین قابلیتهای بخش دولتی و خصوصی ایجاد کند.

۴-۱- خطرات اخلاقی

۴-۱-۱- دادههای ناکافی یا منحرف در سیستمهای هوش مصنوعی

سیستمهای هوش مصنوعی ظرفیت تداوم یا ایجاد نتایج نامطلوب یا مضر را دارند که ناشی از دادههای ناقص یا ناکافی و همچنین نحوه تلاقی استفاده از هوش مصنوعی با رویههای نهادی و اجتماعی است که ماهیت انسانمحور یا سیستمی دارند.

تشخیص این نکته مهم است که الگوریتمها بهصورت مستقل عمل نمیکنند؛ آنها در هر مرحله، از انتخاب مدل و دادههای آموزشی گرفته تا تنظیم دقیق و تنظیم پارامترها، ازسوی انتخابهای انسانی شکل میگیرند. ازآنجاییکه سیستمهای هوش مصنوعی معمولا از دادههای تولیدشده ازسوی انسان یاد میگیرند، ناگزیر دیدگاهها و رفتارهای اجتماعی موجود را منعکس میکنند. علاوهبراین، در دولت، الگوریتمها بهندرت بهطور مستقل تصمیمگیری میکنند؛ آنها معمولا بهعنوان ابزارهایی عمل میکنند که تصمیمگیری انسان را آگاه کرده و بر آن تاثیر میگذارند، نه اینکه جایگزین آن شوند. حتی در مواردی که سیاستها با هدف استانداردسازی هستند، اجرای موفقیتآمیز هنوز بهشدت به زمینه محلی و «تعامل آشفته چندین بازیگر با دانش متنوع» بستگی دارد. این تعامل بین هوش مصنوعی و قضاوت انسانی به این معنی است که خطاها نهتنها در خروجیهای الگوریتمی، بلکه در نحوه تفسیر و اعمال توصیههای تولیدشده ازسوی هوش مصنوعی نیز میتوانند وجود داشته باشند؛ بنابراین، درک چگونگی پردازش و پاسخ تصمیمگیرندگان به اطلاعات تولیدشده ازسوی هوش مصنوعی و اطمینان از داشتن مهارتهای لازم برای استفاده از هوش مصنوعی به شیوهای قابل اعتماد، بسیار مهم است. از یک طرف، ذهنیت شناختی باوجود بیطرفی ادراکشده هوش مصنوعی، همچنان در شکلدهی به تعاملات انسان و هوش مصنوعی مرتبط است، درحالیکه از سوی دیگر، ماشینها فاقد همدلی هستند؛ بنابراین، مهم است که کارمندان دولت بتوانند با اعمال اختیار عاقلانه، از قضاوت حرفهای و خرد عملی برای تضمین انصاف استفاده کنند.

سیستمهای هوش مصنوعی همچنین به کیفیت دادههای آموزشی بسیار حساس هستند و آنها را مستعد بیشبرازش الگوها، یادگیری همبستگیهای جعلی و تقویت خطاها یا انحرافهای تعبیهشده در مجموعه دادههای تولیدشده ازسوی انسان میکنند. درحالیکه فراخوانی هوش مصنوعی به حذف نویز کمک میکند، همانطورکه در بالا بهعنوان یک مزیت مورد بحث قرار گرفت، ماهیت جستوجوی الگو آن نیز میتواند آن را تشدید کند، بهویژه هنگامی که ناسازگاریهای سیستمی در دادههای آموزشی وجود دارد. بدون نظارت و کاهش دقیق، هوش مصنوعی بهجای ارایه تصمیمات عینی و قابل اعتماد، ریسک تقویت تحریفات را به همراه دارد و این امر نیاز حیاتی به گردآوری و اعتبارسنجی دقیق دادهها، آزمایش سیستم، نظارت و ارزیابی تاثیر پیشبینیکننده و گذشتهنگر و شفافیت الگوریتمی در تصمیمگیری مبتنی بر هوش مصنوعی را برجسته میکند.

بهدلیل ظرفیت تاثیرات سیستمی، دادهها و الگوریتمهای ناکافی یا منحرف میتوانند انواع دیگری از خطرات، مانند مواردی را که در زیر مورد بحث قرار گرفتهاند، نیز تشدید کنند.

۴-۱-۲- سوءاستفاده یا استفاده مشکوک از هوش مصنوعی، منجر به نگرانیهای نظارتی و حریم خصوصی میشود

سوءاستفاده یا استفاده مشکوک از هوش مصنوعی در دولت میتواند منجر به آسیب به اعمال آزادانه آزادیها و حقوق فردی شود. یکی از نگرانیهای برجسته، استفاده از هوش مصنوعی در ارایه خدمات امنیت عمومی و ایمنی است، جایی که امکان شناسایی و ردیابی کارآمد از طریق دادههای بیومتریک و نظارت در زمان واقعی را فراهم میکند. اگرچه این ابزارها میتوانند برای اجرای قانون و پیشگیری از جرم مفید باشند، نگرانیهایی را درمورد حریم خصوصی دادهها و همچنین نظارت و کنترل اجتماعی ازسوی ادارات دولتی ایجاد میکنند؛ برای مثال، در طول همهگیری کووید ۱۹، از هوش مصنوعی برای ردیابی حرکات مردم برای اطمینان از رعایت دستورالعملهای خودقرنطینگی استفاده شد. اگرچه این اقدام برای کنترل شیوع ویروس در نظر گرفته شده بود، نگرانیهایی را درمورد حریم خصوصی در بین عموم ایجاد کرد. درواقع، نظارت مبتنی بر هوش مصنوعی بهطور فزایندهای فراگیر شده است؛ بهطوریکه بنیاد کارنگی برای صلح بینالمللی دریافته است که ۹۷ کشور از ۱۷۹ کشور (۵۴ درصد) مورد تجزیه و تحلیل، از فناوریهای هوش مصنوعی برای نظارت عمومی استفاده میکنند. این شاخص، کشورهای غیردموکراتیک را بهعنوان محرک اصلی نظارت هوش مصنوعی، ازجمله ازطریق فروش محصولات به سایر کشورها، شناسایی کرد. بااینحال، کشورهای دیگر، ازجمله دموکراسیهای لیبرال، نیز از کاربران اصلی نظارت هوش مصنوعی هستند. قانون هوش مصنوعی اتحادیه اروپا، زمان مجاز استفاده از هوش مصنوعی برای نظارت را تنظیم میکند و مواردی از استفاده را که «خطر غیرقابل قبول» هستند و در سراسر اتحادیه اروپا ممنوع شدهاند، شناسایی میکند.

بهطور مشابه، ارایه خدمات شخصیسازیشده اغلب به پردازش الگوریتمی دادههای پراکنده در منابع داده عمومی و گاهی خصوصی متعدد نیاز دارد. این امر نگرانیهای مربوطبه حریم خصوصی را افزایش میدهد و نیاز دولتها را به دنبال کردن ارایه خدمات کارآمد و همچنین حفاظت قوی از حقوق حریم خصوصی افراد برجسته میکند؛ برای مثال، برای ارایه خدمات اجتماعی شخصیسازیشده، دولتها ممکن است دادههایی را از سوابق مراقبتهای بهداشتی، دستاوردهای تحصیلی، سابقه اشتغال و حتی فعالیت رسانههای اجتماعی جمعآوری کنند. درحالیکه هدف ارایه پشتیبانی متناسب و مداخلات بهموقع است، پردازش چنین حجم عظیمی از اطلاعات شخصی باید بادقت و عمدی انجام شود و کنترلهایی برای کاهش نگرانیهای مربوط به نظارت وجود داشته باشد.

یکی دیگر از موارد سوءاستفاده، امتیازدهی اجتماعی در ارایه خدمات یا سیاستگذاری است؛ روشی که در آن افراد براساس رفتار یا ویژگیهای شخصی طبقهبندی میشوند. الگوریتمهای هوش مصنوعی، دادهها را از منابعی مانند رسانههای اجتماعی، تراکنشهای مالی و سوابق عمومی برای اختصاص امتیاز تجزیه و تحلیل میکنند. این امتیازها میتوانند بر دسترسی به خدمات، وامها و فرصتهای شغلی تاثیر بگذارند و منجر به رفتار ناعادلانه شوند. استفاده دولت از چنین سیستمهایی در اتحادیه اروپا بهعنوان یک استفاده غیرقابل قبول ممنوع است.

در یک نظرسنجی اخیر از صدها متخصص در زمینههای مختلف، ۷۹ درصد گفتند که هوش مصنوعی تا سال ۲۰۴۰ تاثیر منفی بر حریم خصوصی مردم خواهد داشت، نگرانی که عموم مردم نیز با آن موافق هستند. دولتها باید اطمینان حاصل کنند که استفاده آنها از هوش مصنوعی قابل اعتماد است تا این نگرانیها را کاهش دهند، زیرا این نگرانیها مربوط به هوش مصنوعی در دولت است.

سوءاستفاده احتمالی از ابزارهای هوش مصنوعی برای نظارت بر شهروندان ازسوی مقامات میتواند منجر به زیادهروی و سوءاستفاده از قدرت شود. نظارت مداوم و جمعآوری دادهها میتواند فضایی از ترس و بیاعتمادی ایجاد کند، بهویژه در میان جوامعی که ممکن است از قبل احساس کنند بهطور نامتناسبی ازسوی نیروهای انتظامی هدف قرار گرفتهاند. دولتها همچنین میتوانند از هوش مصنوعی برای تقویت قدرت سیاسی استفاده کنند و بهطور بالقوه سلطه و اقتدارگرایی گسترده را تسهیل کنند، بهویژه ازسوی دولتهای غیردموکراتیک یا دولتهایی که حفاظت از حقوق بشر را در اولویت قرار نمیدهند. برخی از کارشناسان معتقدند که هوش مصنوعی میتواند -و در برخی موارد درحالحاضر نیز استفاده میشود- برای ردیابی و نظارت بر شهروندان و ساکنان در مقیاس بزرگ، با استفاده از الگوریتمها و تحلیل رفتاری، شناسایی و سرکوب مخالفان و تداوم رژیمهای تمامیتخواه.

در نهایت، دستکاری الگوریتمی، که در آن سیستمهای هوش مصنوعی و نتایج آنها برای تولید نتایج خاص تغییر داده میشوند، یکی دیگر از سوءاستفادههای بالقوه و رفتار غیراخلاقی در استفاده دولتی از هوش مصنوعی است. این دستکاری میتواند ناشی از تغییر عمدی نتایج سیستم ازسوی کارمندان دولت، تصمیمگیرندگان یا توسعهدهندگان سیستمهای هوش مصنوعی باشد که به نفع یا آسیب رساندن به گروهها یا افراد خاص یا پیشبرد یک دستورکار خاص انجام میشود. پیچیدگی ذاتی هوش مصنوعی علاوهبراین میتواند ردیابی و درک عملکرد داخلی الگوریتمها را چالش برانگیز کند.

۴-۱-۳-عدم شفافیت و قابلیت توضیح

سیستمهای مبتنیبر یادگیری عمیق «جعبههای سیاه» هستند، به این معنی که توصیف نحوه تولید یک خروجی مشخص ازسوی آنها دشوار است. چنین خروجیهایی بهطور غیرمستقیم از آموزش یادگیری عمیق تولید میشوند، زیرا مهندسان بهطور مداوم پارامترها را تغییر میدهند تا مدل در اهداف آموزشی امتیاز بالایی کسب کند. حتی دانشمندانی که روی مدلهای پیشرفته یادگیری عمیق کار میکنند، عملکرد داخلی سیستمهای خود را درک نمیکنند و ردیابی این خروجیها و آزمایش قابلیت اطمینان این سیستمها از طریق روشهای سنتی برایشان دشوار است.

این امر تشخیص و کاهش پیامدهای مضر را دشوار میکند و چالشهایی را در تعیین پاسخگویی در هنگام بروز مشکلات ایجاد میکند. با ادغام فزاینده سیستمهای هوش مصنوعی در عملکردهای دولت، سیستمهای جعبه سیاه میتوانند توضیح منطق تصمیمات مبتنی بر هوش مصنوعی را برای شهروندان دشوار کنند. همچنین میتواند سایر خطرات هوش مصنوعی را تشدید کند؛ برای مثال، شناسایی سوگیری الگوریتمی و علل ریشهای آن در سیستمهای غیرشفاف میتواند دشوارتر باشد. کارمندان دولت همچنین میتوانند بهطور فزایندهای حس اعتماد کاذبی به سیستمهای هوش مصنوعی بهظاهر کارآمد اما ناقص داشته باشند، زیرا چنین نقصهایی ممکن است غیرقابل مشاهده باشند. این امر میتواند با محدود کردن توانایی آنها در تصمیمگیری آگاهانه یا قراردادن آنها در معرض تصمیمات مبهم و ناقص مبتنی بر هوش مصنوعی، پاسخگویی دولت را تضعیف کرده و مردم را ناتوان سازد.

۴-۲- ریسکهای عملیاتی

۴-۲-۱- «سوگیری اتوماسیون» – اتکای بیشازحد به هوش مصنوعی

بسیاری از مردم سیستمهای هوش مصنوعی و تصمیمات آنها را خنثی و بیطرف میدانند و این امر باعث میشود کاربران نتایج را بدون بررسی دقیق بپذیرند. مطالعات انجامشده درمورد تصمیمگیری با کمک هوش مصنوعی، تمایل به اضافه وزن دادن به توصیههای الگوریتمی را شناسایی کردهاند، که اغلب فرض میکنند پیشبینی آنها قابلاعتمادتر از قضاوت انسانی است -حتی زمانی که خود سیستم هوش مصنوعی محدودیتهایی دارد. این «سوگیری اتوماسیون» (تمایل مردم به اعتماد به خروجیهای هوش مصنوعی به دلیل منطقی و خنثی به نظر رسیدن آنها) میتواند منجر به استفاده از تصمیمگیری هوش مصنوعی در تعداد فزایندهای از چالشهای اجتماعی شود- شاید برای جلوگیری از گفتوگوها و تصمیمات دشوار درمورد رویکردهای انسانی به این مسایل. برخی کارشناسان ادعا میکنند که این عادت باعث ایجاد «ایمان کورکورانه» به فناوری میشود، پدیدهای مشکلساز که میتواند مسایل سیستمی موجود را علیه گروهها یا افراد خاص تقویت کند و به نادیده گرفتن رنجهای انسانی و فرسایش همدلی کمک کند.

اصطلاحا «سوگیری اتوماسیون» در دولت زمانی رخ میدهد که سازمانهای دولتی یا کارمندان دولت برای تصمیمگیری یا اجرای وظایف، بیشازحد به سیستمهای هوش مصنوعی متکی باشند؛ برای مثال، اگر متخصصان مراقبتهای بهداشتی بیشازحد به پیشنهادهای خودکار هوش مصنوعی بدون بررسی متقابل متکی باشند، ممکن است اطلاعات حیاتی را از دست بدهند یا تشخیصهای نادرستی بدهند. این وابستگی بیشازحد میتواند منجر به عدم تشخیص اشتباهات ازسوی کاربران، پذیرش خروجیهای نادرست هوش مصنوعی و کاهش نظارت و قضاوت انسانی شود. هوش مصنوعی میتواند بهطور سیستماتیک بدون ارزیابی کامل دقت و پیامدهای احتمالی اتخاذ شود و منجر به اتکا به سیستمهای هوش مصنوعی و انتشار خطاهای ترکیبی در کل سیستمها شود.

یکی از عوامل موثر در چنین مسایلی، توهمات است که زمانی رخ میدهد که سیستمهای هوش مصنوعی مولد، حقایق را به روشی معتبر میسازند، اغلب زمانی که پاسخ صحیحی در دادههای آموزشی یافت نمیشود. این امر میتواند در زمینههایی مانند تصمیمگیریهای دولتی مضر باشد، جایی که ممکن است منجر به تصمیمات یا اقدامات نادرست شود؛ برای مثال، یک سیستم هوش مصنوعی که برای پاسخ به سوالات عمومی طراحی شده است، میتواند جزییات نادرستی درمورد خدمات عمومی ارایه دهد یا خدماتی را که وجود ندارند فهرست کند. اگر بهدقت کاهش نیابد، این عواقب ناخواسته و خروجیهای نادرست میتوانند بهسرعت گسترش یابند و بر جمعیتهای بزرگ یا تصمیمات حیاتی داخلی دولت تاثیر بگذارند.

سیستمهای هوش مصنوعی همچنین میتوانند مستعد اشتباهات و نقصهای ساده باشند که میتواند منجر به انحرافات سیستماتیک و عدم دقت در خروجیهای الگوریتمی شود. اگر این سیستمها بهدقت پیادهسازی نشوند یا از نظر فنی قابلاعتماد نباشند، اعتماد عمومی، ازجمله کارمندان دولت را کاهش میدهند. شهروندان ممکن است بهدلیل پردازش نادرست درخواستهای خود یا تاخیر در ارایه خدمات، بارها دچار ناامیدی شوند؛ برای مثال، سیستمهای خودکار که ارسال فرم، سوالات خدمات مشتری و درخواستهای پرداخت را مدیریت میکنند، باید با دقت زیادی کار کنند. در غیر این صورت، اشتباهات یا اشکالات فنی میتواند منجر به تصور بیکفایتی و عدم اطمینان در خدمات عمومی شود. مشکلات یا خطاهای فنی در تعاملات چتبات، مانند پاسخهای نادرست، عدم توانایی در درک پرسشها یا قطع سیستم، میتواند اعتماد را بیشتر از بین ببرد و باعث شود شهروندان احساس کنند که سیستمهای هوش مصنوعی غیرقابل اعتماد و ناکارآمد هستند.

ریسکگریزی نیز در «سوگیری اتوماسیون» نقش دارد. کارمندان دولت ممکن است از ترس اینکه بعدا دچار مشکل شوند، از پذیرفتن مسوولیت شخصی تصمیمات خود بترسند؛ برای مثال، زمانی که یک انسان برخلاف توصیه یک سیستم هوش مصنوعی تصمیم میگیرد و معلوم میشود که تصمیم اشتباه بوده است. در چنین مواردی، کارمند دولت دو برابر مسوول به نظر میرسد. برخی از سیستمهای هوش مصنوعی دولتی حتی به گونهای طراحی شدهاند که کارمندان دولت را مجبور میکنند در صورت مخالفت با توصیه یک سیستم هوش مصنوعی، توجیهاتی برای بررسی بنویسند و این امر به بار کاری آنها میافزاید و انگیزهها را برای پیروی از توصیههای سیستم تقویت میکند.

تحقیقات همچنین مفهوم پایبندی گزینشی را برجسته میکند که در آن تصمیمگیرندگان وقتی توصیههای الگوریتمی با باورهای از پیش موجود یا کلیشههای اجتماعی خود همسو میشوند، بیشتر احتمال دارد از آنها پیروی کنند. این میتواند منجر به تصمیمگیریهای عمومی تحریفشده شود، زیرا کارمندان دولت ممکن است ناخودآگاه از خروجیهای هوش مصنوعی برای توجیه تعصبات از پیش موجود بهجای ارزیابی انتقادی آنها استفاده کنند.

برخی تحقیقات نشان میدهد که اتکای بیشازحد به هوش مصنوعی ممکن است به کاهش تواناییهای شناختی انسان، کاهش اکتشاف، خلاقیت و تفکر مستقل، منجر شود، زیرا افراد به راهحلهای تولیدشده ازسوی هوش مصنوعی عادت میکنند. مطالعات نشان میدهد که اتکای مکرر به سیستمهای پشتیبانی تصمیمگیری مبتنیبر هوش مصنوعی میتواند منجر به تخلیه شناختی و کاهش مشارکت افراد در تفکر انتقادی و حل مساله مستقل شود. تصمیمگیری مبتنیبر هوش مصنوعی همچنین خطر ترویج همگنسازی رفتاری را به همراه دارد، زیرا خروجیهای آن اغلب منعکسکننده تنوع محدودی از دیدگاهها هستند. این محدود کردن دیدگاهها میتواند مانع تفکر تطبیقی شود و ظرفیت جوامع و دولتها را برای پیمایش عدم قطعیت و ریسک کاهش دهد. اگرچه اتکای بیشازحد به هوش مصنوعی ممکن است خطراتی را به همراه داشته باشد، ابزارهای هوش مصنوعی همچنین میتوانند به اپراتورهای انسانی در تفسیر و زیر سوال بردن تصمیمات پیچیده هوش مصنوعی کمک و از اتکای بیشازحد جلوگیری کنند.

۴-۲-۲- کاهش کیفیت شغلی برای کارمندان دولت

درحالیکه هوش مصنوعی میتواند کیفیت شغلی و رفاه کارمندان دولت را افزایش دهد، همانطور که در بالا بحث شد، برخی از کاربردها میتوانند اثر معکوس داشته باشند. استفاده از ابزارهای مدیریت الگوریتمی به طور قابل توجهی درحال افزایش است و به نرخ پذیرش ۹۰ درصد در شرکتهای آمریکایی و ۷۹ درصد در اتحادیه اروپا رسیده است. درحالیکه مطالعات خاص بخش دولتی انجام نشده است، نگرانیهای ملموسی درمورد تاثیرات منفی موجود هوش مصنوعی و ابزارهای الگوریتمی بر کیفیت شغل، ازجمله تشدید کار، افزایش استرس، کاهش ادراکشده در انصاف و نظارت بر محل کار مطرح شده است؛ برای مثال، هوش مصنوعی میتواند با ایجاد انواع جدید نظارت در محل کار، یا اشکال جدید «تیلوریسم دیجیتال» فوقالعاده کارآمد اما طاقتفرسا، که در آن کار تحت نظارت و تنظیم بیشتر، ازجمله از طریق مدیریت الگوریتمی، قرار میگیرد، شغلها را کمارزشتر و استرسزاتر کند. تحقیقات بیشتر نشان داده است که چنین نظارت هوش مصنوعی میتواند به سلامت روان آسیب برساند و مدیریت وظایف هوش مصنوعی میتواند استقلال و صدای کارگران را از بین ببرد و بینش انسان درمورد نحوه مدیریت کار را کاهش دهد. بااینحال، اگر بهخوبی استفاده شود، نشان داده شده است که چنین ابزارهایی ایمنی و رفاه کارگران را نیز بهبود میبخشند (برای مثال با هشداردادن به کارگران درمورد خطرات و ریسکها، یا شناسایی فرسودگی شغلی). مدیریت الگوریتمی و تاثیرات آن درحالحاضر باتوجهبه کاربردشان در بخش خصوصی مشاهده و مطالعه میشود. تحقیقات درمورد مدیریت الگوریتمی در بخش دولتی کمیاب است، اگرچه استفاده از آن بهسرعت درحال گسترش است.

۴-۲-۳- تنشهای حریم خصوصی و مدیریت دادهها

توسعه و استقرار سیستمهای هوش مصنوعی، چالشهایی درمورد حریم خصوصی و مدیریت دادهها در طول چرخه عمر هوش مصنوعی ایجاد میکند. در مرحله آموزش هوش مصنوعی، بسیاری از توسعهدهندگان برای ساخت مجموعه دادههای آموزشی هوش مصنوعی به منابع عمومی وابسته هستند که ممکن است عمدا یا سهوا شامل دادههای شخصی یا اطلاعات مشمول حقوق مالکیت معنوی باشند. بااینحال، صرفا به این دلیل که دادهها در اینترنت قابل دسترسی هستند، بهطور خودکار به این معنی نیست که جمعآوری و استفاده از آنها برای آموزش مدلهای هوش مصنوعی رایگان است. علاوهبر این، افراد ممکن است دادههای شخصی خود را با رضایت به استفاده یا استفادههای دیگری به اشتراک گذاشته باشند که لزوما شامل آموزش مدلهای هوش مصنوعی نمیشود. جمعآوری دادههای شخصی برای آموزش سیستمهای هوش مصنوعی، مانند هر فعالیت پردازش داده، تابع اصول حریم خصوصی شناختهشدهای است که در توصیهنامه OECD در مورد دستورالعملهای حاکم بر حفاظت از حریم خصوصی و جریانهای فرامرزی دادههای شخصی آمده است. این اصول مستلزم آن است که دادههای شخصی از طریق روشهای قانونی و منصفانه و با آگاهی شخص موضوع دادهها به دست آیند و هرگونه استفاده بیشتر از دادهها با اهداف اصلی ناسازگار نباشد.

جنبه مهم دیگری که باید در نظر گرفته شود، ظرفیت مدلهای هوش مصنوعی برای بهخاطرسپردن دادههای شخصی در پارامترهای خود در طول مرحله آموزش است. در نتیجه، LLM های پشت ابزارهای هوش مصنوعی مولد مبتنی بر متن، خطر خاصی از دسترسی غیرمجاز و استفاده از دادههای شخصی شخص ثالث را بدون اطلاع افراد مربوطه ایجاد میکنند. برخی تحقیقات همچنین نشان میدهد که مدلهای هوش مصنوعی مولد قادرند ویژگیهای شخصی موضوع داده را از متن با دقت بالا و درعینحال با هزینه کم استنباط کنند. این امر نگرانیهایی را در مورد حریم خصوصی ایجاد میکند، نهتنها به این دلیل که این استنباطها میتوانند اطلاعات شخصی یا ویژگیهای شخصی را آشکار کنند، بهویژه هنگامی که چنین ویژگیهایی قرار نبوده به اشتراک گذاشته شوند.

در طول مرحله استقرار، سیستمهای هوش مصنوعی همچنین میتوانند با حقوق افراد برای دسترسی، تصحیح و در صورت لزوم حذف دادههای شخصی خود (که در دستورالعملهای حریم خصوصی OECD بهعنوان «اصل مشارکت فردی» نیز شناخته میشود) در تضاد باشند؛ برای مثال، احقاق حقوق افراد برای حذف یا اصلاح دادههایشان میتواند از نظر فنی پیچیده و نیازمند منابع زیادی باشد، زیرا ممکن است نیاز به شناسایی نقاط داده خاص مربوط به یک فرد در مجموعه دادههای بدون ساختار یا در برخی موارد آموزش مجدد مدل هوش مصنوعی داشته باشد. علاوهبر این، تحقیقات انجامشده قبل از استفاده گسترده از مدلهای هوش مصنوعی مولد نشان میدهد که در موارد خاص، میتوان با تجزیه و تحلیل رفتار مدلی که شامل آن دادهها است، دادههای آموزشی اصلی را بازسازی یا از حالت ناشناس خارج کرد. برای مقابله با چنین تنشهایی، ترویج همکاری بینالمللی بیشتر بین جوامع حریم خصوصی دادهها و هوش مصنوعی میتواند به هماهنگسازی رویههای داده با توسعه و استفاده از هوش مصنوعی کمک کند.

۴-۲-۴- تهدیدهای سایبری

سیستمهای هوش مصنوعی که در فرآیندهای دولتی گنجانده شدهاند، میتوانند در برابر تهدیدهای سایبری آسیبپذیر باشند که میتواند منجر به نقض دادهها، نقض حریم خصوصی و ازدستدادن عملکرد شود. جمعآوری و تجزیه و تحلیل گسترده دادههای شخصی برای برنامههای کاربردی هوش مصنوعی میتواند منجر به ازدسترفتن، تغییر یا افشای غیرمجاز این دادهها شود و حقوق حریم خصوصی افراد را نقض کند. دسترسی غیرمجاز و نقض دادهها میتواند دادههای شخصی و یکپارچگی عملیاتی را به خطر بیندازد که میتواند منجر به سرقت هویت، کلاهبرداری مالی و سایر نقضهای حریم خصوصی، تضعیف اعتماد عمومی به نهادهای دولتی و درنتیجه پیامدهای قانونی شود. علاوهبراین، بازیگران سایبری مخرب میتوانند سیستمهای هوش مصنوعی را دستکاری کنند، خروجیهای آنها را تغییر دهند و باعث تصمیمات یا اقدامات نادرست شوند. خطرات سایبری ممکن است از بازیگران بد خارجی یا از تهدیدهای داخلی در دولت ناشی شود. درمجموع، امنیت سایبری را میتوان بهعنوان یک عملکرد افقی دولت در نظر گرفت و در واقع یکی از زمینههای پذیرش گسترده هوش مصنوعی در دولت برای افزایش امنیت سیستمهای فناوری اطلاعات دولتی است.

۴-۳- خطرات محرومیت

۴-۳-۱- تشدید شکافهای دیجیتال

خطر حذف افراد هنگام استفاده از هوش مصنوعی در دولت، ارتباط نزدیکی با شکافهای دیجیتال دارد، شکاف بین کسانی که میتوانند به فناوریهای اطلاعات و ارتباطات دسترسی داشته باشند و از آنها استفاده کنند و کسانی که نمیتوانند. این امر بهویژه در ارایه خدمات عمومی و فعالیتهای سیاستگذاری، بهویژه در استفاده از هوش مصنوعی برای تجزیه و تحلیل پیشبینی، پیشبینی و شخصیسازی خدمات، مشهود است.

شکافهای دیجیتال، دسترسی به مزایا و ارزشهای عمومی را که هوش مصنوعی ارایه میدهد با خطر مواجه میکند. این امر بهویژه در میان جمعیتهایی که فاقد زیرساختهای لازم و سواد دیجیتالی برای تعامل با خدمات عمومی مبتنی بر هوش مصنوعی هستند، صادق است. هوش مصنوعی در دولت میتواند مزایایی -مانند اطلاعات سفارشی، زمان پاسخ سریعتر و ارایه خدمات پیشرفته- ارایه دهد اما ممکن است برای کسانی که به اینترنت یا مهارتهای دیجیتال دسترسی ندارند، غیرقابل دسترس باشد. تغییر دولتها بهسمت دیجیتالی شدن میتواند موانع خدمات دولتی دیجیتال را در میان بخشهای خاصی از جمعیت تشدید کند. تحقیقات در کانادا نشان داد که کاربران در مناطق روستایی، زنان و دختران و افراد خانوادههای کمدرآمد، تحت تاثیر منفی فشار بهسمت خدمات دیجیتال بهدلیل همهگیری کووید ۱۹ قرار گرفتهاند. در نروژ، دیجیتالی شدن و اتوماسیون سیستم اعطای مزایای کودک، امکان دریافت خودکار این مزایا را برای اکثر دریافتکنندگان فراهم کرد. درعینحال، این امر منجر به نیاز سایر دریافتکنندگان به درخواست دستی شد.

شکاف دادهها نوع دیگری از محرومیت ناشی از هوش مصنوعی است که با دادههای غیرنماینده مرتبط است، که نتیجه شکافهای دیجیتالی موجود است. افرادی که به اینترنت دسترسی ندارند، اغلب در دادههای مورد استفاده برای توسعه الگوریتمها غایب هستند. ازآنجاکه بیشتر دادهها عمدتا ازطریق اینترنت و تعاملات آنلاین جمعآوری میشوند، استفاده گسترده از هوش مصنوعی ممکن است این افراد را حذف کند، زیرا الگوریتمهای مورداستفاده برای اطلاعرسانی در سیاستگذاری فاقد دادههای نماینده هستند. این شکافها، پاسخگویی مناسب به نیازهای همه شهروندان را برای دولتها دشوار میکند و منجر به مجموعه دادههای ناکافی یا نامناسب در فرآیندهای تصمیمگیری مبتنی بر هوش مصنوعی و ارایه خدمات میشود؛ برای مثال، شکاف دادهها، ظرفیت مزایای هوش مصنوعی، مانند خدمات هوش مصنوعی شخصیسازیشده را محدود میکند و آنها را فقط برای جمعیتهای غنی از داده مفید و دقیق باقی میگذارد.

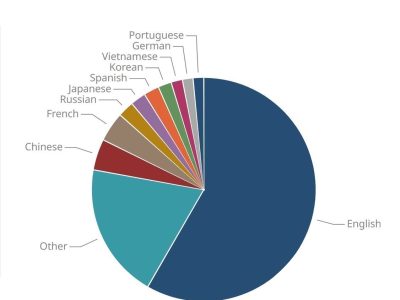

شکل دیگری از شکاف دیجیتال شامل عدم نمایش کافی زبانهاست. همانطور که در شکل ۱.۴ مشاهده میشود، مجموعه دادههای آموزشی تمایل دارند زبانهای پرکاربرد را بیشازحد نمایش دهند. این عدم تعادل میتواند منجر به سیستمهای هوش مصنوعی شود که نمیتوانند بهطور موثر به گروههای زبانی غیرغالب خدمترسانی کنند. تلاشهای حفظ زبان، مانند طرح «اهدای سخنرانی» در استونی، محدودیتهای فعلی فناوری گفتار را که به نفع زبانهای شناختهشدهتر است، کاهش میدهد و ارایه خدمات را بهبود میبخشد.

۴-۳-۲- جابهجایی نیروی کار خدمات عمومی

سازمان همکاری و توسعه اقتصادی (OECD) دریافت که اگرچه هوش مصنوعی قادر به خودکارسازی وظایف غیرروزمره است، تاثیرات آینده آن بر نیروی کار مبهم است؛ این تاثیرات به تعادل بین جایگزینی نیروی کار انسانی ازسوی هوش مصنوعی، افزایش تقاضای نیروی کار بهدلیل بهرهوری بیشتر ناشی از هوش مصنوعی و ایجاد مشاغل جدید ناشی از پذیرش هوش مصنوعی بستگی دارد. هوش مصنوعی میتواند با خودکارسازی وظایف، بهرهوری دولت را افزایش دهد و همچنین ظرفیت کاهش نیاز به نیروی کار انسانی را دارد که به نیاز به آموزش مجدد کارمندان دولت برای انجام وظایف معنادارتر منجر میشود.

در عینحال، استقرار هوش مصنوعی باعث افزایش تقاضا برای مهارتهای مرتبط با هوش مصنوعی در سراسر اقتصاد میشود و بخش دولتی نیز از این قاعده مستثنا نیست. با افزایش نقشهای مرتبط با هوش مصنوعی، ممکن است تلاشهای استخدام و حفظ نیرو برای موقعیتهای غیر هوش مصنوعی یا سنتی کاهش یابد که این امر نیاز به نیروی کار ماهر در هوش مصنوعی و فناوریهای مرتبط را برای برآورده کردن تقاضاهای درحال تحول برجسته میکند.

فناوریهای هوش مصنوعی طیف وسیعی از مشاغل و بخشها را تحتتاثیر قرار میدهند و بر کارگران در تمام سطوح مهارت تاثیر میگذارند و بر بازارهای کار تاثیر میگذارند. درحالیکه برخی از کارمندان دولت ممکن است با هوش مصنوعی سازگار شوند و حتی شاهد بهبود کار خود باشند، برخی دیگر، مانند کارگران مسنتر و کممهارت که وظایفی را انجام میدهند که بهراحتی خودکار میشوند، با خطرات قابلتوجهی روبهرو هستند. این نشان میدهد که مزایای هوش مصنوعی بهطور مساوی بین کارمندان دولت تقسیم نمیشود؛ برای مثال، چتباتهای مبتنی بر هوش مصنوعی اکنون معمولا برای ارایه خدمات و ارتباطات شهروندمحور برای پاسخ به سوالات اساسی و ارایه اطلاعات استفاده میشوند، که تقاضا برای نمایندگان خدمات مشتری انسانی دولتی را کاهش میدهد.

سالهاست که نگرانیها درمورد اتوماسیون شغلی بر نیروی کار کممهارت متمرکز بوده است اما وظایف با شناخت بالا بهطور فزایندهای ازسوی هوش مصنوعی پشتیبانی میشوند که میتواند بر کارمندان دولت مانند تحلیلگران سیاست تاثیر بگذارد. هوش مصنوعی مولد میتواند متن معناداری تولید کند، تجزیه و تحلیل دادهها را انجام دهد و حتی راهبردهای سیاستی را برای پرداختن به چالشهای پیچیده پیشنهاد دهد. بسیاری از کارمندان دولت باید برای همکاری موثر با هوش مصنوعی و تمرکز بر تفکر استراتژیک و تصمیمگیری سطح بالاتر آموزش ببینند.

۴-۴- خطرات مقاومت عمومی

۴-۴-۱- شهروندان ممکن است خروجیهای مبتنی بر هوش مصنوعی را بهصورت گزینشی بپذیرند، که بهطور بالقوه به خطاها کمک میکند

درک تعاملات انسان و هوش مصنوعی بهطور فزایندهای بهعنوان یک چالش کلیدی برای مدیریت عمومی تلقی میشود و پیامدهای قابلتوجهی برای اعتماد و مشروعیت دارد. با ادغام هوش مصنوعی ازسوی دولتها در تصمیمگیری، پذیرش عمومی این سیستمها حیاتی میشود. تحقیقات نشان میدهد که تصمیمات الگوریتمی، باوجود وعده بیطرفی، همیشه منصفانه یا مشروع تلقی نمیشوند، بهویژه هنگامی که با انتظارات افراد مغایرت دارند یا فاقد شفافیت هستند.

شهروندان تصمیمات الگوریتمی را ازطریق ادراکات شناختی و باورهای قبلی پردازش میکنند؛ آنها اغلب بهصورت گزینشی توصیههای تولیدشده ازسوی هوش مصنوعی را که با انتظاراتشان همسو است، میپذیرند و درعینحال در برابر توصیههای خلاف آن مقاومت میکنند. این پیروی گزینشی میتواند خطاها را در تصمیمگیریهای دولتی تقویت کند، زیرا افراد ممکن است زمانی که پیشبینیهای الگوریتمی کلیشههای از پیش موجود یا دانش قبلی خود را تایید میکنند، بیشتر به آنها اعتماد کنند.

4-4-2- فقدان توانمندسازی و درک عمومی در مورد نحوه استفاده دولت از هوش مصنوعی

اغلب در بین مردم، بهطورکلی و بهطور خاص، نحوه استفاده دولت از هوش مصنوعی، دانش و درک کمی وجود دارد. این میتواند منجر به تصورات غلط و ترس در مورد قابلیتهای آن و اینکه آیا دولتها از آن به شیوهای قابل اعتماد استفاده میکنند یا خیر، شود. این امر میتواند بهطور بالقوه منجر به پیامدهایی مانند شایعاتی شود که به صورت آنلاین در مورد استفاده دولت از هوش مصنوعی در سیاستگذاری یا ارایه خدماتی مانند وام، دسترسی به عدالت یا مزایای اجتماعی منتشر میشود. این امر میتواند به این دلیل رخ دهد که پیچیدگی هوش مصنوعی اغلب بهاشتباه درک میشود و منجر به فرضیات نادرست در مورد نحوه تصمیمگیری، منصفانه بودن نتایج و توانایی پاسخگو نگهداشتن این سیستمها میشود؛ یا بهدلیل شفافیت محدود در مورد نحوه استفاده مقامات دولتی از هوش مصنوعی. این شفافیت محدود یا شکاف در درک، مردم را بیشتر مستعد بدبینی نسبتبه اقدامات و نیات دولتها میکند و درنتیجه در برابر راهحلهای مبتنی بر هوش مصنوعی در خدمات عمومی مقاومت ایجاد میکند.

تصمیمات هوش مصنوعی میتواند بیشازحد سختگیرانه یا غیرقابل پاسخگویی تلقی شود، بهویژه در غیاب نظارت انسانی یا راههای جبران خسارت. تحقیقات نشان میدهد که وقتی شهروندان در تعامل با سیستمهای خودکار احساس ناتوانی میکنند – مانند عدم توانایی در به چالش کشیدن تصمیمات نادرست مبتنی بر هوش مصنوعی – هزینههای روانی و انطباق بالاتری را تجربه میکنند.

برعکس، سطوح بالاتر توانمندسازی عمومی و شفافیت در استفاده، دانش و درک هوش مصنوعی با اعتماد بیشتر به توانایی دولت در استفاده مسوولانه از هوش مصنوعی مرتبط است. شهروندان آگاه، احتمال بیشتری دارد که اقدامات حفاظتی و ملاحظات اخلاقی اعمال شده ازسوی دولت را تشخیص دهند و اعتمادبهنفس خود را درمورد شایستگی و صداقت در بهکارگیری فناوریهای هوش مصنوعی تقویت کنند.

۴-۴-۳- سوءاستفاده از هوش مصنوعی و رسواییها میتواند اعتماد را تضعیف کرده و به مقاومت عمومی کمک کند

استفاده از هوش مصنوعی در دولت منجر به چندین رسوایی بزرگ و موارد آسیب در دنیای واقعی شده است. این امر هزینههای بالای سوءاستفاده از هوش مصنوعی را برجسته میکند، بهطوریکه مسایلی که سالها پیش اتفاق افتادهاند، هنوز در گفتمان عمومی مطرح هستند. شکستهای بزرگ در یک سیستم هوش مصنوعی میتواند اعتماد به طیف وسیعتری از موارد استفاده دولتی را از بین ببرد. واکنشهای منفی عمومی حتی منجر به کنارهگیری مردم از اشتراکگذاری دادهها یا ایجاد مانع در استفاده از ابزارهای موجود شده است.

واکنشهای منفی عمومی بهویژه زمانی محتمل است که خطاهای هوش مصنوعی منجر به آسیبهای قابل مشاهده، مانند محرومیت نادرست از مزایا یا رفتار ناعادلانه براساس پیشبینیهای نادرست، شود. شکستهای بزرگ میتوانند شک و تردید عمومی را تقویت کرده و نگرانیهایی را ایجاد کنند که تصمیمات مبتنی بر هوش مصنوعی ممکن است عدالت رویهای و پاسخگویی دموکراتیک را تضعیف کند. دادههای OECD AI Incidents Monitor (AIM) نشاندهنده رشد حوادث و خطرات هوش مصنوعی گزارش شده ازسوی منابع رسانهای معتبر در سالهای اخیر است (شکل ۱.۵).۱۷ تا آوریل ۲۰۲۵، ۳۸۱۶ مورد از ۱۴۹۸۱ حادثه فهرست شده (۲۵ درصد) مربوط به «دولت، امنیت و دفاع» بوده است که نشان میدهد دولتها باید اطمینان حاصل کنند که خطرات را کاهش میدهند تا اعتماد شهروندان را جلب کنند.

شهروندان همچنین میتوانند از خود بیزاری الگوریتمی نشان دهند و اغلب بهدلیل ترجیح دادن به عاملیت و کنترل شخصی، در برابر تصمیمگیری الگوریتمی مقاومت میکنند، حتی زمانی که سیستمهای هوش مصنوعی از انسانها بهتر عمل میکنند. این بیمیلی با تحمل بیشتر خطاهای انسانی در مقایسه با اشتباهات الگوریتمی تقویت میشود؛ مردم پس از مشاهده یک شکست، تمایل دارند اعتماد خود را به هوش مصنوعی از دست بدهند، درحالیکه نسبتبه خطاهای مشابه انجامشده ازسوی انسانها بخشندهتر هستند. بیزاری الگوریتمی میتواند در برخی از عملکردها (مانند امنیت عمومی) نسبتبه سایر عملکردها (مانند مدیریت عمومی) رایجتر باشد، که میتواند به چالشهای مختلف و سطوح مختلف بلوغ در عملکردهای دولتی منجر شود. ارایه بینش به کاربران درمورد استدلال پشت توصیه هوش مصنوعی یا ارایه کنترل محدود برای تغییر خروجی آن میتواند بهطور قابلتوجهی پذیرش را بهبود بخشد و احتمال پذیرش توصیههای مبتنی بر هوش مصنوعی ازسوی کاربران را افزایش دهد. فراتر از افزایش خطرات مقاومت عمومی، بیزاری از الگوریتمها ازسوی کارمندان دولت میتواند مانع از توانایی دولتها در بهرهبرداری از مزایای هوش مصنوعی شود.

۴-۵- خطرات عدم اقدام

مهمترین خطرات هوش مصنوعی شامل پیامدهای استقرار و پذیرش آن است. بااینحال، یک خطر کمتر مورد بحث شامل تاخیر در استفاده از هوش مصنوعی برای دستیابی به مزایای مثبت در دنیای واقعی، ازجمله در دولت و خدمات عمومی است. مطالعه صدساله دانشگاه استنفورد درمورد هوش مصنوعی اشاره کرد که «پیشرفتهای متعدد در هوش مصنوعی میتواند هزینهها را کاهش دهد،

ری و تحول را تقویت کند.

کاراییهای جدیدی را معرفی کند و کیفیت زندگی را افزایش دهد… بااینحال، این روشها بهطور گسترده مورد استفاده قرار نگرفتهاند. انتقال کند این فناوریها به جهان به مرگ و میر و هزینههای غیرضروری منجر میشود. نیاز فوری به درک بهتر چگونگی انتقال سریعتر شایستگیها و پیشرفتهای ارزشمند موجود هوش مصنوعی به عمل در دنیای واقعی وجود دارد.» درحالیکه این مطالعه بیش از یک دهه قدمت دارد، نتیجهگیری همچنان یکسان است، بهخصوص در دولت. فراتر از فرصتهای ازدسترفته، خطر عدم اقدام در زمینه هوش مصنوعی، شکاف بین ظرفیت بخش دولتی و بخش خصوصی را افزایش میدهد. این نهتنها به این معنی است که دولتها میتوانند در توانایی خود در استفاده از هوش مصنوعی، بلکه در توانایی خود در تنظیم این فناوری نیز عقب بمانند. کارشناسان هوش مصنوعی معتقدند که یکی از مهمترین خطرات هوش مصنوعی، ناتوانی سازوکارها و نهادهای حاکمیتی در همگام شدن با تحولات سریع هوش مصنوعی است.

برخی تحقیقات نشان میدهند که تبلیغات منفی و ترس درباره هوش مصنوعی میتواند به این خطر دامن بزند. چنین تحقیقاتی خاطرنشان میکند که محدودیتهای دیگر ممکن است شامل کمبود دادههای مناسب، سردرگمی درمورد مسایل و پیچیدگیهای حریم خصوصی و مقابله با سیستمهای فناوری اطلاعات قدیمی و منسوخ باشد. کارشناسان همچنین مساله «فلج تحلیل» -ترس از اشتباه در هوش مصنوعی- را بهعنوان احتمالی که میتواند اجرای حتی تلاشهای کمخطر را فلج کند و مزایای قابلتوجهی را از دست بدهد، نسبت دادهاند. این موضوع در دولت نیز صادق بوده است؛ آخرین کار مشترک OECD در مورد هوش مصنوعی در دولت نشان داد که دولتها باید بهجای تمرکز نامتناسب بر جلوگیری از جنبههای منفی، جنبههای مثبت استفاده از هوش مصنوعی را بهتر ترویج و فعال کنند. این تمرکز بر خطرات ممکن است مانع از بهکارگیری کاربردهای پرمنفعت و کمخطر هوش مصنوعی برای بهبود سیاستها و خدمات عمومی شود.

۵- تحقق آیندهای مثبت برای هوش مصنوعی در دولت

همانطور که در بالا بحث شد، دولتها بهدنبال استفاده از هوش مصنوعی برای افزایش بهرهوری، با عملیات داخلی کارآمدتر و سیاستها و خدمات موثرتر؛ پاسخگویی، ازطریق رویکردهای متناسب که نیازهای درحال تحول شهروندان و مشاغل را برآورده میکند؛ و پاسخگویی با افزایش ظرفیت نظارتی خود هستند. بااینحال، ظرفیت استفادهنشده فوقالعادهای برای دولتها وجود دارد تا از فناوریهای هوش مصنوعی امروزی استفاده کنند و برای گشودن فرصتهای ارایهشده ازسوی هوش مصنوعی فردا آماده شوند. بااینحال، چشماندازی از آیندهای که در آن دولتها با موفقیت هوش مصنوعی قابل اعتماد را توسعه داده و بهکار میگیرند، درحال ظهور است. این چشمانداز تاکید میکند: «هوش مصنوعی را نه بهعنوان فرصتی برای خودکارسازی بخش دولتی، بلکه برای بازآفرینی آن ببینیم. ما از یک چشمانداز بلندمدت برای تحول خدمات عمومی استقبال میکنیم که در آن هوش مصنوعی بهجای رهبری، از آن پیروی میکند؛ چشماندازی که مبتنی بر مشروعیت عمومی و حرفهای باشد. رهبران بخش دولتی باید بهجای تمرکز صرف بر افزایش فوری بهرهوری یا خودکارسازی وضع موجود، به گسترش هوش مصنوعی بهعنوان فرصتی برای بازآفرینی دولت نگاه کنند. هوش مصنوعی باید بهعنوان شتابدهندهای برای طراحی مجدد اساسی خدمات در نظر گرفته شود و شهروند را در مرکز ارایه خدمات عمومی قرار دهد.»

دولتها با دنبالکردن هوش مصنوعی به عنوان بخشی از استقرار دیجیتال خود، میتوانند بهجای بهینهسازی، نحوه دستیابی به ماموریتهای خود، ارایه ارزش عمومی و ارتقای رفاه اجتماعی را متحول کنند.

قابلیتها و کاربردهای آینده هوش مصنوعی ممکن است مزایا و تغییراتی را به همراه داشته باشد که درحالحاضر غیرممکن یا حتی غیرقابل تصور هستند. این موضوع درمورد خطرات احتمالی آن نیز صادق است. دولتها و سازمان همکاری و توسعه اقتصادی باید در ارزیابی چگونگی تاثیر فناوریها و برنامههای در حال تکامل هوش مصنوعی بر موسسات دولتی، کارمندان دولت و جامعه بهطورکلی هوشیار باشند – و ارزیابی و سازگاری مداوم را در خدمت منافع عمومی تضمین کنند.

سازمان همکاری و توسعه اقتصادی (OECD) از طریق تحلیل و ترکیب کارکردهای دولت و برای بحث بیشتر در مورد هوش مصنوعی در دولت، تحقیقات جامعی را درمورد روندهای فعلی استفاده از هوش مصنوعی در کارکردهای دولتی انجام داده و درسهای اولیهای را از این موارد استفاده شناسایی کرده است. این تحقیق و یافتههای آن در بخش بعد مورد بحث قرار گرفته است.

دیدگاهتان را بنویسید